日本時間2022年6月17日、Metaは研究開発部門の情報公開イベント「Inside the Lab」を開催した。メディア向けに定期的に開催が行われており、第4回目となる今回のテーマは「VRヘッドセットのディスプレイ」。MetaのReality Labが「Oculus」だった時代からこれまでに取り組んできた概念実証や最新技術、そして数々のプロトタイプが明らかにされた。

「ビジュアル・チューリング・テスト」をクリアするために

「Inside the Lab」はMetaのCEO、マーク・ザッカーバーグ氏が「今日はVRとARに向けた、次世代ディスプレイの構築に必要なことについて話したいと思います」と語るところからスタートした。

続いてOculus時代からチーフサイエンティストを務めるマイケル・エイブラッシュ氏が参加。ザッカーバーグ氏とエイブラッシュ氏の二名が、現在Reality Labsが取り組んでいる「ビジュアル・チューリング・テスト」について語った。

前段として、「チューリング・テスト」が何なのかを簡単に説明しておきたい。「チューリング・テスト」とは、ざっくりと言えば「何らかの機械等が出力した結果を見て、それが人間だと感じられるか」を判定するためのテストのことだ。

今回のケースではこれをVRの「視覚」に関連する部分に当てはめ、「その体験が(視覚的に)、人間にとって現実のものだと感じられるか(=バーチャルな環境にいても、それがバーチャルだとわからないようなレベルに達しているか)」を判定するためのテストを「ビジュアル・チューリング・テスト」と呼称しているようだ。

様々な企業がVRヘッドセットの解像度や視野角、映像の歪みやレイテンシーの解決に日夜研究を重ねていることからも、この「ビジュアル・チューリング・テスト」をクリアすることの困難さは、察するに余り有るだろう。

ディスプレイ技術にあらゆる方向から取り組む

話を戻そう。ザッカーバーグ氏とエイブラッシュ氏は、「ビジュアル・チューリング・テストを解決する技術は一般消費者向けのVRにはまだ搭載されていない」「2Dディスプレイには存在しない、専門的な問題が山積みになっている」としつつ、Metaがそれらの課題をクリアすべく取り組んできた技術的チャレンジについて、「解像度」「可変焦点」「歪みの補正」そして「HDR(ハイダイナミックレンジ)」を題材に語った。

人の目レベルの高解像度をテストした「Butterschotch」

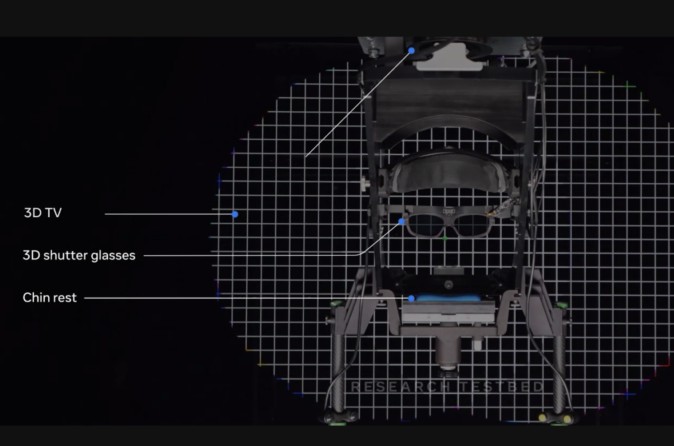

まずザッカーバーグ氏が挙げた要素は「人の目レベルの解像度」あるいは「網膜解像度(Retinal Resolution)」。これらをテストするために作られたプロトタイプが、下の写真のデバイス「Butterscotch」だ。

(「Butterscotch」の外観。「Oculus Rift」をベースに作られているのか、ロゴがひっそりと「Oculus」のままで残っている。基板がむき出しだが、本記事で紹介するデバイスはすべて概念実証用や技術検証のためのプロトタイプであり、製品化を前提としていない点に留意されたい。画像提供: Meta)

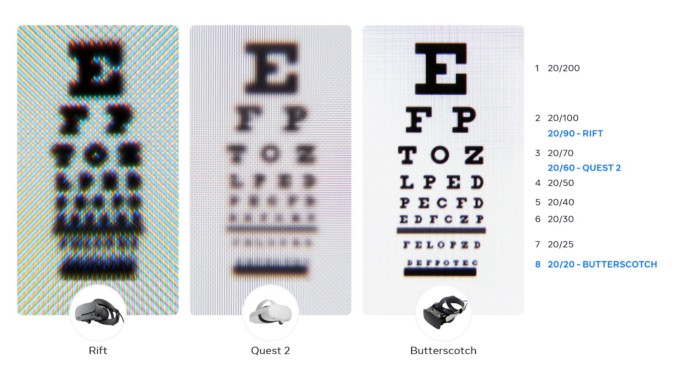

「Butterscotch」は水平視野角1度あたり55ピクセル、すなわち55ppdを実現している。米国で言えば20/20、日本の視力の基準で言えば1.0相当であり、「Oculus Rift」や「Meta Quest 2」と比較するとその鮮明さが分かりやすい。

(左からOculus Rift、Meta Quest 2、そして「Butterscotch」の解像度比較。「Butterscotch」は水平視野角をMeta Quest 2の約半分にし、専用のカスタムレンズを使うことで視野全体で非常に鮮明な映像が得られる。画像提供: Meta)

ザッカーバーグ氏も「驚くほどシャープな映像が見れる」と語る。いわゆる「人の目レベル」の解像度の具体的な数値については様々な主張があるが、Metaは「60ppd」を基準に置いており、「Butterscotch」はそれにかなり近いレベルにまで迫っている。

「可変焦点」のプロトタイプ「Half Dome」

続いて登場したのは、「可変焦点(バリフォーカル)」のプロトタイプ「Half Dome」だ。現在のVRヘッドセットは基本的に焦点が1.5mから2mの間で固定されており、「手元の物体にピントを合わせる」といった機能が搭載されていない。一方で人間の目はこうした機能を備えているがゆえに、「可変焦点がない」ことはVRにおける不快感や違和感を生むひとつの理由にもなる。

そして、ユーザーの目がどこを・何を見ているかをアイトラッキング(視線追跡)で検知し、焦点の合う・合わないを自動で変え、現実そのもののような見え方を提供するのが、Metaの「可変焦点」についての考えだ。

(2018年のOculus Connect 6で発表された「可変焦点」のイメージ。手前にいるロボットは焦点が合っていないためぼやけているが、背景にある物体には焦点が合っているのでくっきり見える)

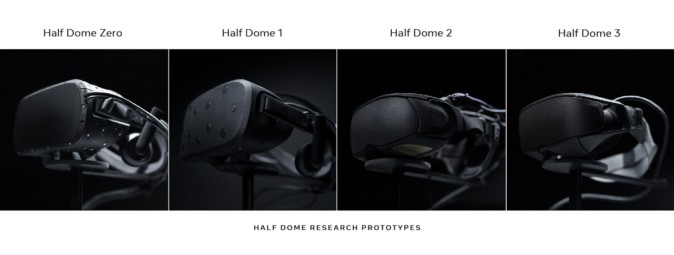

Metaはこの「可変焦点」についてかなり早い段階、2015年から取り組みを続けている。初期のプロトタイプは「Time Machine」と呼ばれており、その後「Half Dome Zero」「Half Dome 1」……とナンバリングになって研究が継続されているようだ。「Half Dome 1」は2018年のF8で発表され、その後2019年のOculus Connect 6で「2」と「3」が併せて発表されている。

(可変焦点のプロトタイプ「Half Dome」たち。現在は完全に電子的な液晶レンズをベースにした可変焦点システムで、年々コンパクトな方向に進化していることがうかがえる。画像提供: Meta)

この「可変焦点」を実現するプロトタイプこと「Half Dome」の開発を経て、固定焦点と可変焦点でユーザーテストを行ったところ、参加者の大半は「可変焦点の方が快適で、疲れづらく、小さいものが識別しやすく、VRで文字を読むのも楽」と回答したという。

しかし「可変焦点」を一般ユーザーも使える製品へまとめ上げることはまだ難しいようだ。ザッカーバーグ氏も「これほどの進展があっても、可変焦点機能を持つハードウェアの性能を完全に最適化し、さらにアイトラッキングの信頼性を高めてこの機能を実現するには、まだまだやるべきことがたくさんあります」「これらの機能をあらゆる人が常に使えるようにする必要があります。非常に高いハードルです」と語る。

仮に「可変焦点」と、先ほどの「Butterscotch」で示された「超高解像度」をセットにすることを考えるならば、「遠近問わずピントが合い、約60ppdという超高解像度を常に実現できるVRヘッドセット」となる。Metaが研究を続けている課題の大きさが少なからず推し量れるのではないだろうか。

「歪みの補正」のためのプロトタイピング時間を劇的に短縮

Metaが取り組んでいる技術的課題は解像度や焦点に限らない。次にザッカーバーグ氏とエイブラッシュ氏が挙げたのは「歪みの補正」だ。

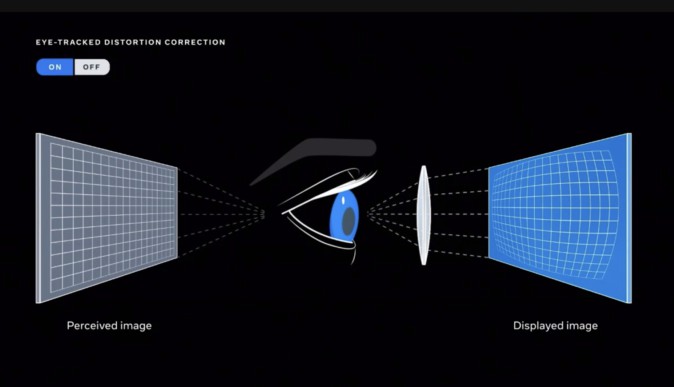

「Oculus Rift DK1」の時代から、VRヘッドセットはわざと映像を歪ませてからディスプレイに出力している。なぜこんなことをするのかと言えば、普通に2Dディスプレイ向けの映像を出してしまうと、レンズを使って視野いっぱいに映像を広げる際に「歪んだ映像」になってしまうからだ。

(上述した「映像の歪み」のイメージ。左側が「知覚される映像」、右側が「ディスプレイ上に実際に出ている映像」。レンズを通すことで、格子模様が“正しく”見えるようになる。これをアイトラッキングと組み合わせることで、より精度の高い補正が可能だ。画像提供: Meta)

なので、あらかじめレンズで生じる歪みを計算しておき、最初から映像を歪ませる。そしてレンズを通る際にその歪みを相殺することで、ようやくVRヘッドセットで見る映像が「普通の景色」に見えるようになる(「相殺」という表現はあくまで便宜的なものなので、厳密には異なるはずなのだが、どうかご容赦いただきたい)。

しかしこの「歪みの補正」を行うシステムは、少なくとも今のところは動的なものではない。つまり、「ユーザーの視線に合わせて、常に細かく調整されながら歪み補正が行われている」のではなく、「最初から固定的に歪み補正がされている」レベルにとどまっているということだ。エイブラッシュ氏も「Questのソフトウェアでは、今のところ高いレベルで歪みの補正はできていますが、多くの場合、完璧ではありません。目の動きに合わせてシーンがほんの少し動いてしまうのです。そのため動的な、可変焦点を使ったものに対応する必要がありますが、ユーザーが感知できないほど速い調整が必要です」と語る。

さて、この「歪みの補正」アルゴリズムの検討における一番の課題は、「とても長い時間がかかること」だとエイブラッシュ氏は言う。必要なレンズの製作には数週間から数カ月かかる上に、新しいレンズで機能するディスプレイシステムを開発するのにも長い期間が必要だ。この問題を解決すべく、Metaは仮想オブジェクトを使った歪み補正のシミュレーター製作に踏み切っている。

バーチャルなオブジェクトとアイトラッキングを組み合わせ、指定した光学設計を持つVRヘッドセットでの歪みを再現するシミュレーターを製作。これにより、実際にVRヘッドセットを作らずとも、様々な設計や歪み補正のアルゴリズムを研究・検討できるようになった。エイブラッシュ氏いわく「動的な歪み補正システムを、数ヶ月ではなく、文字通り数分で検討できる」という。

ザッカーバーグ氏も「アイトラッキングはVRやARにおいて過小評価されていますが、光学的な歪みの補正や、何を詳細にレンダリングするかを決める、つまりシステムが何に注目するかという点において非常に重要です。ウェアラブルデバイスにおいては熱や電力供給が限られるため、システムの最後の1ビットまで能力を引き出す必要があるのです」と語る。

このように、Metaはデバイスのスペックや解像度をやみくもに上げることだけを目的にしているのではない。むしろウェアラブルデバイスというリソースが非常に限られがちなハードウェアにおいて、最も良い体験を生み出すために様々な研究を行っている側面が強いといえるだろう。Metaが以前から研究を続けている、アイトラッキングを使った動的な「フォービエイテッド・レンダリング」はまさにこの好例だ(これはMeta Quest 2等に搭載されている固定フォービエイテッド・レンダリングとは明確に異なる)。

大きなチャレンジとなるHDR(ハイダイナミックレンジ)

そしてザッカーバーグ氏が「おそらく、最も重要な領域」して語ったのが「HDR(ハイダイナミックレンジ)」だ。テレビ等でも言われる、「従来よりも、さらに明るい/暗いといった表現の幅の広さを可能にする技術」だ。この明るさ・暗さの幅が広がれば、映像表現はより「リアルに」感じられる。しかし現在のディスプレイ技術で実現している明るさは、人間の眼が現実の風景を見た際に感じられる明るさと大きく違う。

エイブラッシュ氏は「HDRにおける重要な指標として“ニト(nits、単位面積あたりの明るさの単位)”がありますが、研究によればテレビにおけるピーク輝度は10,000ニトが望ましい数値だとされています。現在のHDRディスプレイは数百から数千ニトです。しかしVRではMeta Quest 2が100ニト程度であり、ウェアラブルデバイスでこれを超えるのは大きな挑戦です」と語る。

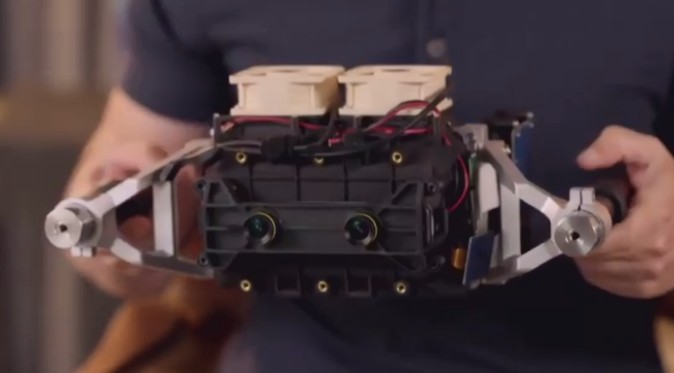

そしてザッカーバーグ氏が取り出したのは、液晶パネルの裏側に光源を取り付けた、HDRをVRで実現するためのプロトタイプ「Starburst」。もちろん「実際に製品として出荷するには、まだこの第一世代では非現実的なもの」(ザッカーバーグ氏)だ。これをベースにHDRを使ったVRシステムの研究を進め、物理環境の複雑さや光を再現できるディスプレイシステムを作ることが目標となる。

(HDRをVRで実現するためのプロトタイプ「Starburst」。最大で20,000ニトに達するという。かなり重いようで、持ち運び用の取っ手がついている。画像提供: Meta)

なお、後に行われたQ&A;において、記者からは「VRでのHDRは目に悪いのではないか?」との疑問も呈されたが、ディスプレイチームからは「(Starburstは)現在のテレビよりも多くの光が目に入るが、それは室内や空間の光と変わりません。少なくとも室内のシーンであれば安全です」との回答があった。

そして現れたプロトタイプ「Holocake」

超高解像度、可変焦点、歪み補正、そしてHDR。ザッカーバーグ氏とエイブラッシュ氏は、ここまでMetaがこれまで取り組んできた「個別の要素」を紹介してきた。

しかし、最終的な製品としてユーザーに届けるためには(これらの技術のブラッシュアップはもちろんだが)、ひとつのハードウェアへと統合する必要がある。彼らはそれをどのような方向性でまとめ上げていくのだろうか。

この日、彼らはさらに新しいプロトタイプを披露した。

ひとつめのプロトタイプが「Holocake 2」である。「2」とある通り既に第二世代目に突入しており、ザッカーバーグ氏は「これまで製作したVRヘッドセットの中で、最も薄く、最も軽い」「既存のPC向けVRタイトルはすべて動かすことができる」と語る。下掲のMetaによる写真を見ていただければ、その圧倒的な「フロント側の薄さ」が分かるだろう。

(「Holocake」の第二世代にあたる「Holocake 2」。PC接続型のVRヘッドセットであり、既存のPC向けVRタイトルは全て動作するという。画像提供: Meta)

(ザッカーバーグ氏が「Holocake 2」を装着している様子。画像提供: Meta)

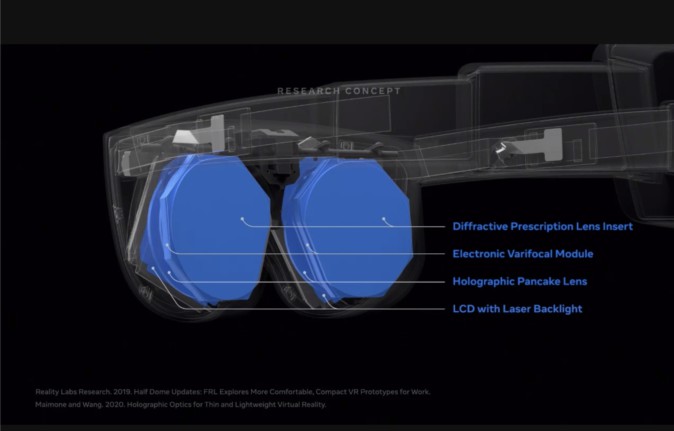

「Holocake 2」では、従来のVRヘッドセットでは大きく異なるアプローチをふたつ行っている。ひとつが「ディスプレイからの光を、レンズではなく、ホログラフィック光学系(HOE)を通して目に届ける」点。もうひとつは「偏光を利用した『光学折り畳み』により、光を複数搭載したレンズ内で反射させる」点だ。これらの非常に複雑な技術の組み合わせにより、「Holocake 2」はパンケーキレンズよりもさらに薄型にし、ディスプレイとレンズ間の距離を縮めている。

なお、Metaがこれらの技術を披露するのは今回が初めてではない。ハードウェアとしては全く異なるものの、2020年6月に発表された論文でその存在が示されているので、詳細に知りたい方はこちらを参照していただきたい。そして、わずか2年でMetaはこれをより洗練させ、プロトタイプ「Holocake 2」として今回お披露目したわけだ。

(VRヘッドセットのディスプレイ-レンズ-目の配置をモデル化したもの。左が従来のレンズを使ったもので、ディスプレイ-レンズ間に距離が必要になる。これを解決しVRヘッドセットを小型化するために、中央の「パンケーキレンズ」を使った仕組みが考案された。そして今回の「Holocake」のシステムは一番右のものになる。画像提供: Meta)

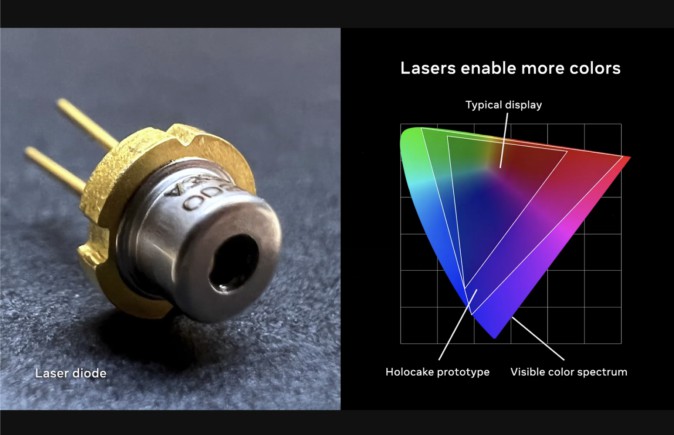

しかし「Holocake 2」にも課題がある。エイブラッシュ氏が明らかにした課題は「光源」だ。先述のように、VRヘッドセットのサイズは光学系に依存するところが大きい。「Holocake 2」は小型化のために様々な技術を結集しているが、これには従来の液晶のバックライトやLED等ではなくレーザー光源が必要だという。「Holocake 2」の光学系がパンケーキレンズを使った光学系よりも小型化できる一方で、現状は光のロスが大きいがゆえだ。

一般ユーザー向けVRヘッドセットに搭載するために十分な性能、サイズ、そして価格を兼ね備えた理想のレーザー光源を想定した場合、現状のレーザー光源は「かなり離れている」とエイブラッシュ氏。安全かつ低コスト、電力効率性にも優れて小型なレーザー光源を実現するためには、多くのエンジニアリングが必要となるようだ。

エイブラッシュ氏は「現時点では適切なレーザー光源が見つけられるかどうかはまだ判断ができる段階ではありませんが、可能であることが証明されれば、サングラス型VRヘッドセットへの道が開かれるでしょう」と語る。ザッカーバーグ氏も「この方向性についてはかなり前向きです」とコメントした。

さらなる次世代VRヘッドセットのコンセプト「Mirror Lake」

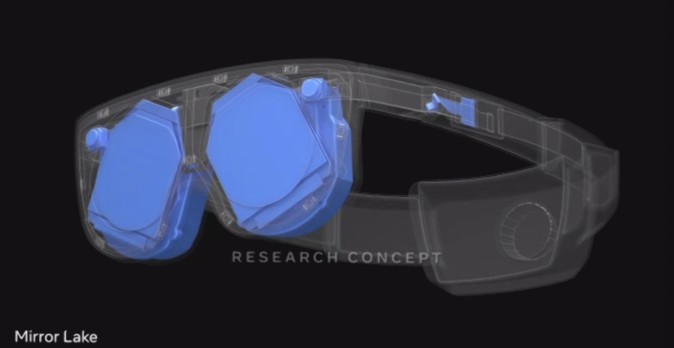

そしてエイブラッシュ氏により「One more design」がもたらされた。「Holocake」のアーキテクチャに、可変焦点やアイトラッキングといった機能を詰め込んだ、スキーゴーグルのような次世代コンセプトデザイン「Mirror Lake」だ。

「究極的な目標は、今日お話しした全ての技術を結集し、ビジュアル・チューリング・テストをクリアするための視覚的な要素を、軽量かつ小型で、電力効率に優れた形態にまとめ上げることです」とエイブラッシュ氏。「Mirror Lake」は、この目標に向けて大きく踏み出すコンセプトとなっている。

(現在開発中のコンセプト「Mirror Lake」。パススルーカメラを使うことで「Project Cambria」のようなMRも体験できる。その他「マルチビューアイトラッキングシステム」や、外向きディスプレイによるリバースパススルーまで搭載するという。画像提供: Meta)

これまで紹介してきたプロトタイプたちと異なり、「Mirror Lake」のハードウェアそのものは直接登場しなかった。それもそのはずで、「Mirror Lake」は「プロトタイプをデザイン中で、現在はコンセプト段階」とのこと。しかし、このコンセプトが正しく実現すれば、「VRにおけるビジュアル体験は劇的に変化するでしょう」とエイブラッシュ氏は語る。

最後にザッカーバーグ氏は、「ARやMR、VRは、特にプレゼンスを与え、ソーシャルなインタラクションを向上させるために、根本的かつ重要な技術になるでしょう」「今回お話ししたような進捗が続けば、私たちがお互いにどうインタラクトしたいか、どう世界を体験したいかを軸に、より人々を中心としたコンピューティングが構築される未来につながると思います。そして、私は今あるものよりもずっといいものになるはずだと思います」と締めくくった。

(MetaのReality Labsで概念実証や技術検証のために作られたプロトタイプたちの一部。今回の「Holocake 2」や「Butterscotch」に「Starburst」、「Half Dome」シリーズ、そして折り畳みホログラフィック光学系の研究用デバイスなどが並ぶ。中央右上のメガネ型のものはARグラス研究開発用の「Project Aria」だろうか)