2017年8月30日から9月1日まで、みなとみらいにてCEDEC2017が開催されました。昨年に引き続きVR関連のセッションも多く開かれ、様々な知見が共有されました。

本記事ではCEDEC2017で開講された、3Dオーディオに関係するセッションの内容をまとめていきます。

(前編 基礎と事例紹介)

1.これで解決!ゲームに必要な3Dオーディオの全て(公式サイト内ページ)

2.VRサウンドデザイン夏期講習:パーソナルスペースの内側で(公式サイト内ページ)

(後編 各論)

3.基礎から応用 3DサウンドAmbisonicでなにができる?(公式サイト内ページ)

4.HRTFを極めた者が3Dオーディオを制する!? ~カプコンとヤマハの3Dオーディオプラグイン共同開発事例~(公式サイト内ページ)

5.VRサウンドの究極演出 リアルタイムバイノーラルの挑戦(公式サイト内ページ)

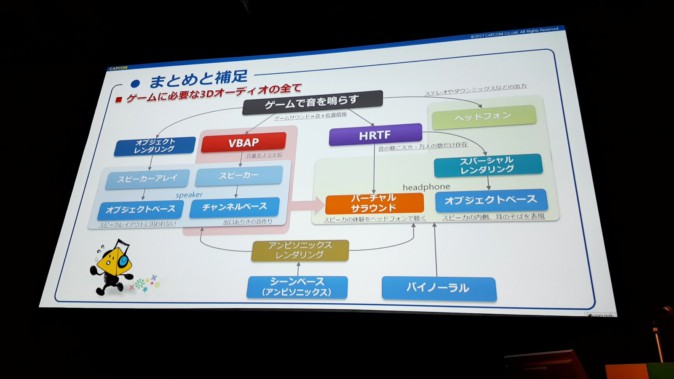

まず1で、3Dオーディオを扱う上で押さえておきたい基本的な用語・原理について解説がなされました。2では、『サマーレッスン』の開発をもとにした実践例が紹介されています。続く3(Ambisonics)4(HRTF)5(バイノーラル)では、それぞれの項目の詳細な解説が行われました。

本記事では、基礎と事例紹介ということで1と2のセッションを紹介します。

1.これで解決!ゲームに必要な3Dオーディオの全て

登壇したのは株式会社カプコンの岸 智也氏。本セッションでは、3Dオーディオを扱う上で押さえておきたい基本的な用語・原理について解説がなされました。

3つの立体音響システム

立体音響(Spatial Audio)を実現するシステムは、以下の3つに分類ができます。

(1)チャンネルベース

(2)オブジェクトベース

(3)シーンベース(Ambisonics)

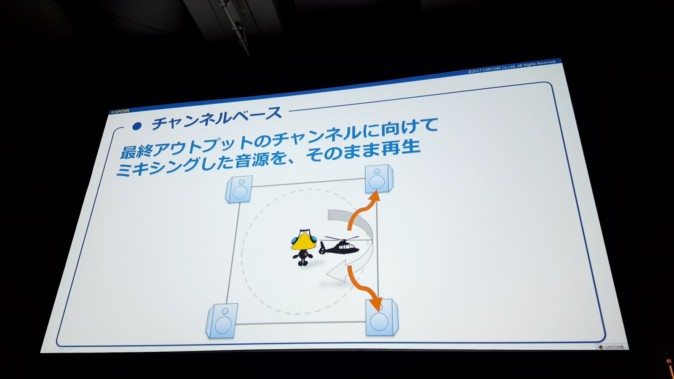

(1)チャンネルベース

ステレオや5.1chなど、想定される出力チャンネルの数に合わせた形で音声をあらかじめ用意しておき、各スピーカーから指定した通りの出力を行うシステム。

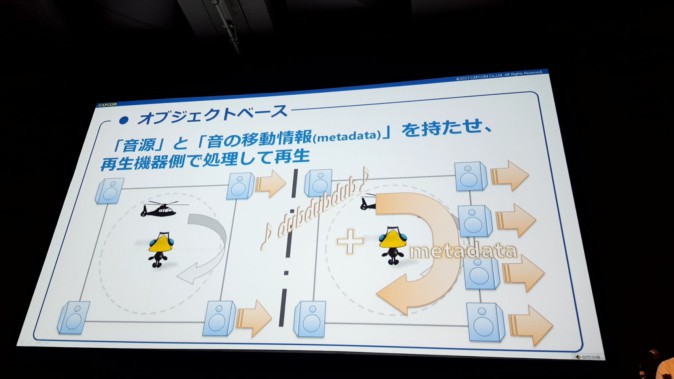

(2)オブジェクトベース

音源そのものが位置情報を持っており、各スピーカーからどんな音を鳴らすかをリアルタイムに計算するシステム。音源の距離減衰や、近場で動き回る音の表現に強い。チャンネル数(ex. スピーカーの数)に依存しない対応ができる。

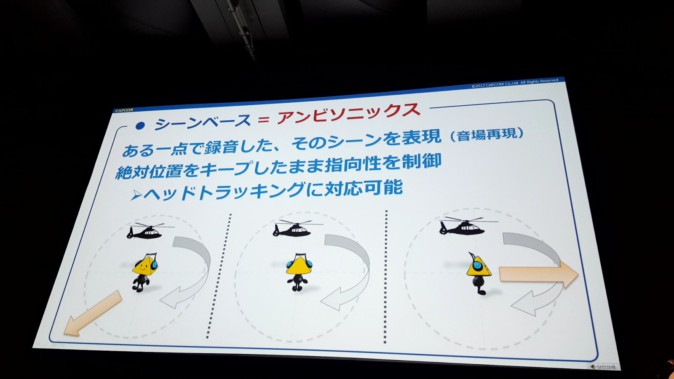

(3)シーンベース(Ambisonics)

ある一点(聴き手)を取り巻く音場全体の物理情報を記録再生するシステム。Ambisonics(アンビソニックス)ともいう。構築した音場は全体を回転させるのが容易で、360度動画などと相性が良い。詳しくは「2.基礎から応用 3DサウンドAmbisonicでなにができる?」にて解説。

押さえておきたい3Dオーディオ関連の用語

上記「~ベース」以外にも、いくつか3Dオーディオ関連の用語が解説されました。

〇サラウンド

ステレオ(LとRの2.0ch)よりも多い数のチャンネルを持つ音声の記録再生方式のこと。たとえば5.1chサラウンドシステムは、5+1=6個のスピーカーを用いて音声出力を行います。

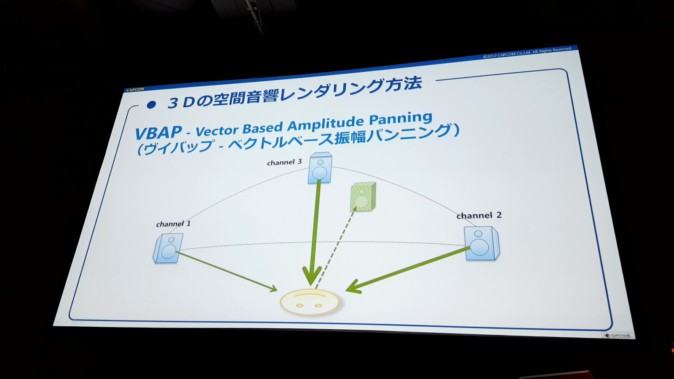

〇VBAP

ある位置(図の緑のスピーカー)で鳴っているように感じさせるため、近くに置かれた実際のスピーカー3つをどのようなバランスで鳴らすか、ベクトル計算によって求める手法。2ch(ステレオ)のパンニングを拡張したものと言えます。

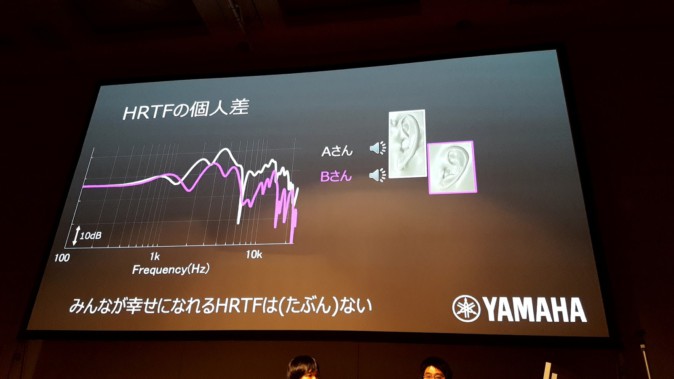

〇HRTF

Head Related Transfer Function、頭部伝達関数のこと。ある音が特定の位置から両耳に届くまでの特性を表すものです。

人間の耳は頭部の側面に一つずつ付いており、左右で物理的に位置が異なります。また耳の形状も人によって異なります。左耳と右耳は、同じ音を聞いているようでいて「音が届くまでの時間」「届いた音の強さ」などが微妙に異なっています。HRTFはこういった物理的要因を考慮し、音がその人にどのように聞こえるかを表しているのです。

(「2.VRサウンドデザイン夏期講習:パーソナルスペースの内側で」の講演より)

(後編記事「4.HRTFを極めた者が3Dオーディオを制する!? ~カプコンとヤマハの3Dオーディオプラグイン共同開発事例~」の講演より)

耳や顔の形状が人によって違うことからわかるように、HRTFには個人差が存在します。

〇バイノーラル

ステレオ録音方式の一つ。「頭についた2つの耳で音を聞く」という環境(“ダミーヘッド”の使用など)を再現して録音することでHRTFを考慮した録音をし、現実環境と同様の聴こえ方を得ることができます。もしくは音が耳に届くまでの道程をHRTFによってシミュレーションすることで臨場感を再現するなど。

(BINAURAL ASMR Whole Head Attention | Tapping, Ear Blowing, Soft Spoken for Sleep)

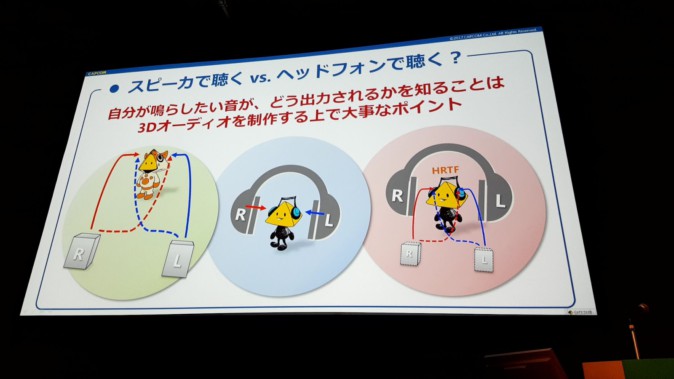

バーチャルサラウンド

バーチャルサラウンドとは、ヘッドホンで聞いているのに、まるで周りにスピーカーが存在しており、そのスピーカーから音が出ているように感じさせる技術。HRTFを用いて音響処理を行うことで実現しています。

左から、スピーカー・ヘッドホン・バーチャルサラウンド。

バーチャルサラウンドを利用すれば、ヘッドホンを使用していても5.1chなどのサラウンド音声を体験可能です。そのようなバーチャルサラウンド技術として講演では、『SMYTH SVS』や『DTS Headphone:X』などが紹介されました。

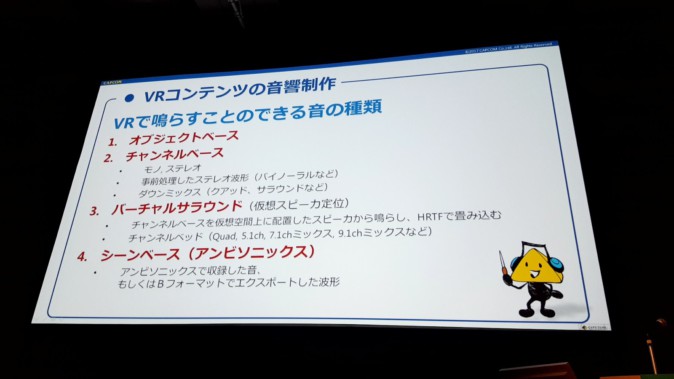

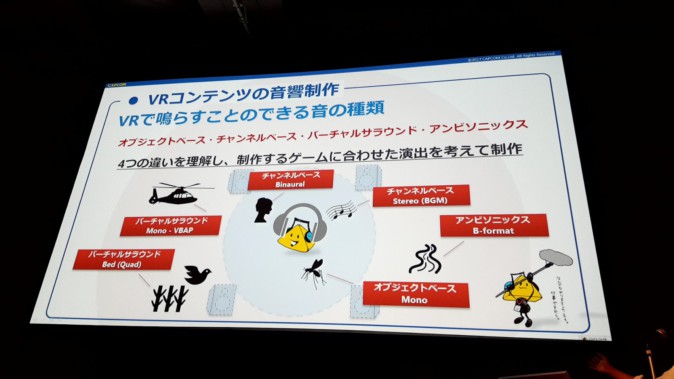

VRコンテンツの音響制作

ゲーム内に存在するオブジェクトすべてを音源としてオブジェクトベースの音声出力を行うと、処理負荷が大きくなってしまいます。そこでこれらのシステムを組み合わせ、1つのシーン例として次のような割り当てが紹介されました。

・鳥や森……バーチャルサラウンド(クァッド)

・ヘリコプター……バーチャルサラウンド(モノラル音声をVBAPで)

・蚊……オブジェクトベース(モノラル音声)

・ナレーション……チャンネルベース(バイノーラル)

・BGM……チャンネルベース(ステレオ音声)

・川の音……アンビソニックス(B-format)

()内は音声フォーマット。

一般にチャンネルベースは「心理音響モデル」と呼ばれ、“聞かせるための音”に向いており、ゲームの「演出」に使うことができます。一方でオブジェクトベースは「物理音響モデル」と呼ばれ、音を「再現」するのに向いています。

どちらが良いということではなく、処理負荷の都合と、その音を鳴らす目的に合った手法を選ぶことが大切だと岸氏は語ります。

2.VRサウンドデザイン夏期講習:パーソナルスペースの内側で

登壇したのは株式会社バンダイナムコスタジオより、中西 哲一氏と田中 佳吾氏。本セッションでは、PlayStation VR向け『サマーレッスン』の開発を通して得られたオーディオについての知見、特に至近距離でのオーディオ体験に関するものが紹介されました。

VRサウンドの特徴

サウンドデザインにおいて、VRコンテンツがこれまでのゲームと違う点として、以下の3つが挙げられました。

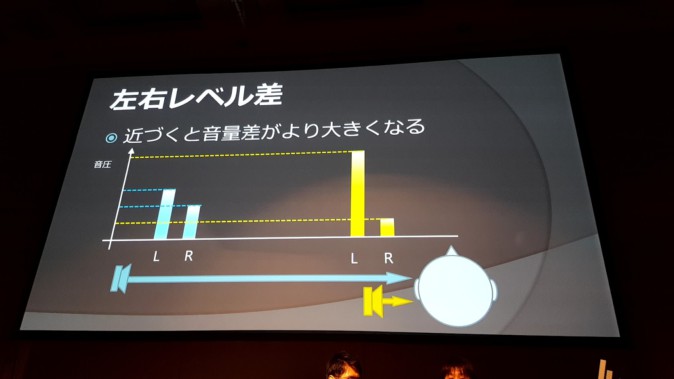

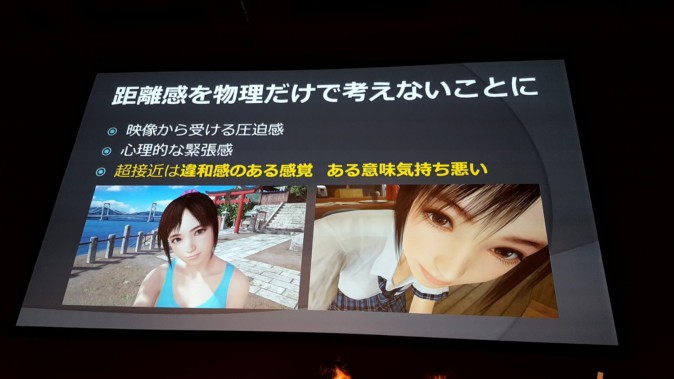

(1)距離感……テレビゲームでは音源(テレビのスピーカーなど)との距離が1メートル以上あるが、VRでは数センチに迫る体験が存在する

(2)立体音響……基本的なプレイはヘッドホンなので、オブジェクトベース・チャンネルベース・シーンベースを上手く使い分ける必要がある

(3)主観と客観……BGMは必要か?使うとしたらそれはどこから鳴っているのか?UIの効果音はどうするか?といったメタ的な問題

以下ではこれらのポイントを踏まえつつ、講演をまとめていきます。

距離感の作り方

『サマーレッスン』開発においては、パーソナルスペース内の存在感・超接近の距離感を最優先するため、「リアルな物理シミュレートを行うことより、感覚的な誇張を行う」という方針をまず先に決めたそう。

「音量を操作するだけではパーソナルスペースの内側の超接近感が出ない」と中西氏。そこで『サマーレッスン』のボイスなどは、距離により周波数フィルタが変化する仕様になっています。会話をするくらいの距離で通常音質になり、至近距離では非常に強い低音ブースト処理が施されるというもの。

不自然な低音ブーストをかけても、視覚情報と統合されることで、違和感のない自然な体験になったと言います。

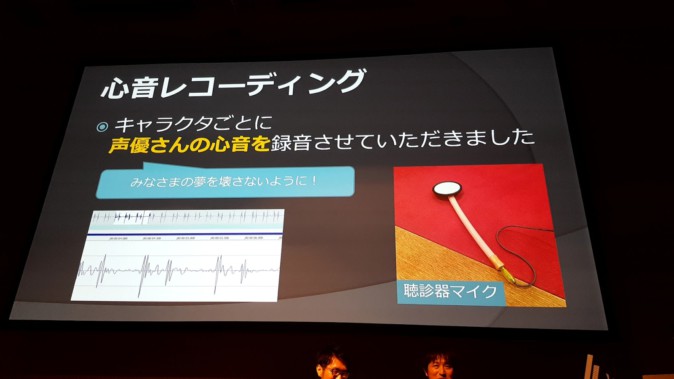

実は『サマーレッスン』では、キャラクターに超接近してめり込んでしまった時に、心音などの生体音が聞こえるという工夫がされています。この心音はなんと声優さん本人のものを収録して使っているそうです。

立体音響とHRTF

『サマーレッスン』でHRTFが適用されている音は、例えば以下のようなものがあります。

〇効果音

『サマーレッスン』のメニューUIでは、空間に置かれているオブジェクトはフィジカルなものと解釈してHRTFを使用、決定音などプレイヤーの意思が関わるものはチャンネルベースで鳴らしています。

〇環境音

セミ・鳥・波などの環境音はHRTFで音源を適度に分散しているものの、HRTFだけでは方向感が強すぎてしまうため、チャンネルベースの音をブレンドして馴染ませています。

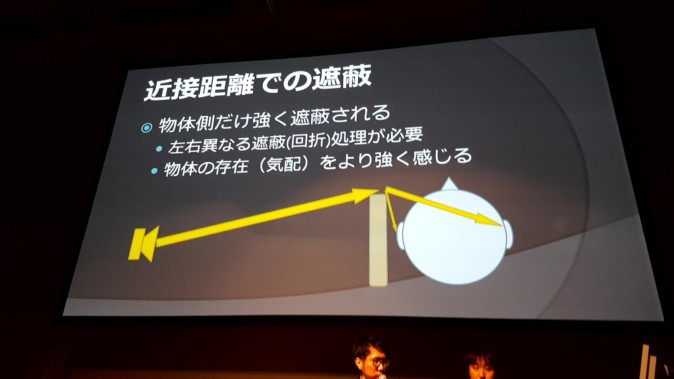

〇電話やイヤホン

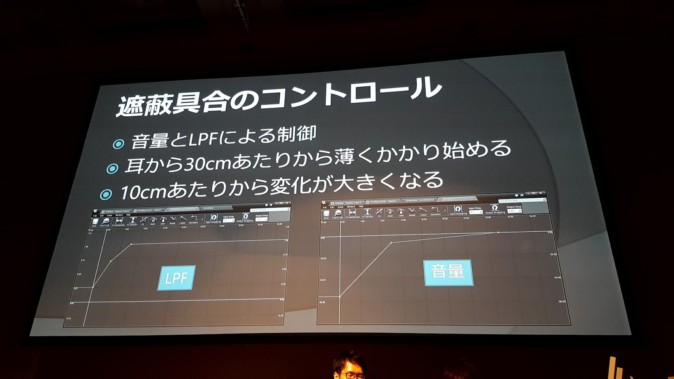

電話やイヤホンなど、耳のすぐそばにオブジェクトが来るときは、外音が遮蔽される仕様になっています。

[wc_row][wc_column size=”one-half” position=”first”]

[/wc_column][wc_column size=”one-half” position=”last”]

[/wc_column][/wc_row]

BGMの取り扱い

VRコンテンツにおけるBGMは、「どこで鳴っているのか分からず、体験として不自然ゆえに没入感を損なう場合もある」ということが言われてきました。

中西氏はBGMが体験を邪魔しないために、「そのシーンで音楽が鳴る自然な状況がある」・「ラジオなどの再生装置があり、さらに空間音響が考慮されている」必要があると説明します。

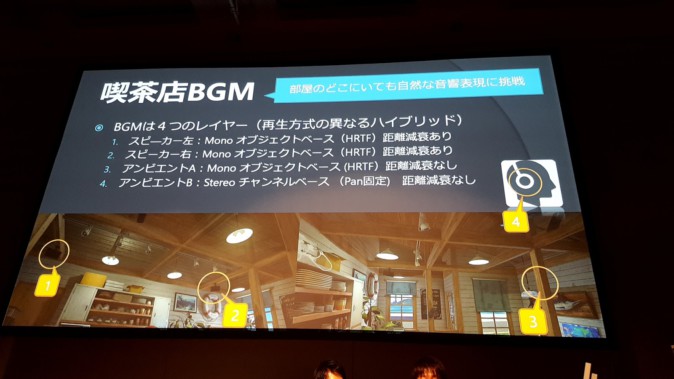

『サマーレッスン』の喫茶店シーンでは、部屋のどこにいても自然な音響表現になるよう、図のような4つの音源を用いてBGMを鳴らしています。

また仮に必然性のないBGMであっても、タイトルやメニューなどのUIが出ているようなシーンでは、プレイヤーは「これはゲームだ」といった感覚が強まるため、BGMが鳴っていても問題ないだろうとのこと。

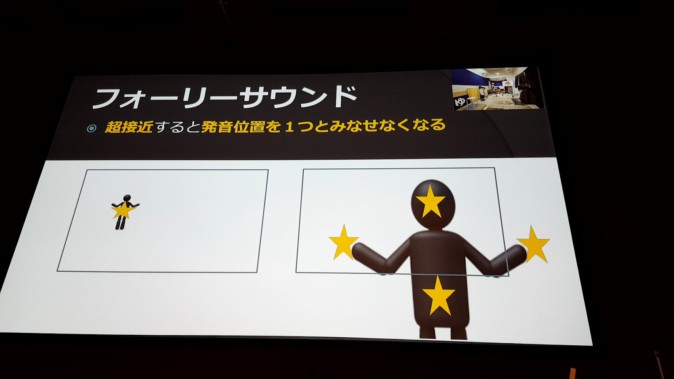

フォーリーサウンドについて

至近距離のサウンドにおける問題として、「遠くでは1点の音源とみなせても、近づくと複数の音源を持っていないと不自然になってしまう」ということが挙げられます。すぐそばにいる人間のすべての挙動(立ち上がる、歩く、手を叩くなど)の音が、胸の一点からしか聞こえて来ない場合、体験としては不自然です。

特に『サマーレッスン』のように、キャラクターの衣装が変わったり、地面の環境が変わったりするコンテンツでは、すべてを個別に設定していては作業量が膨大になってしまいます。

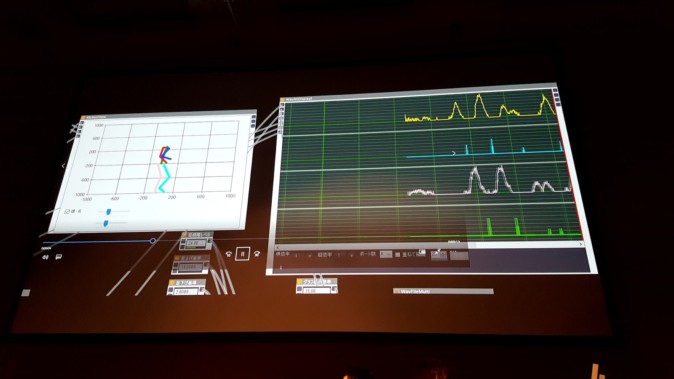

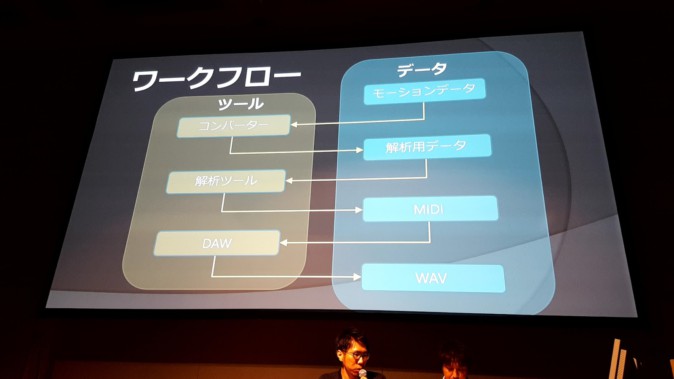

『サマーレッスン』では、「Auto Foley」と称して、アニメーションを解析して、そのタイミングや感度などの情報からサウンドを自動生成してくれるツールを開発・使用しています。

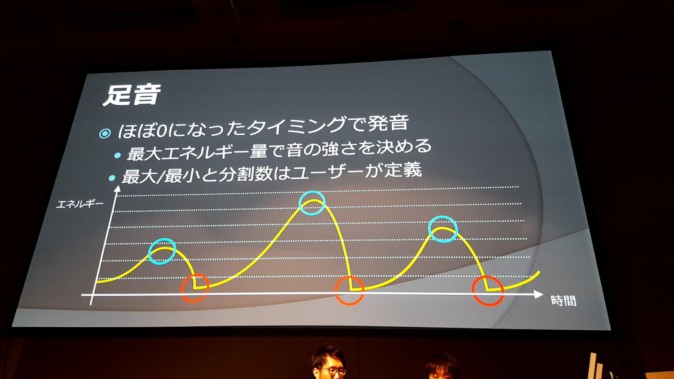

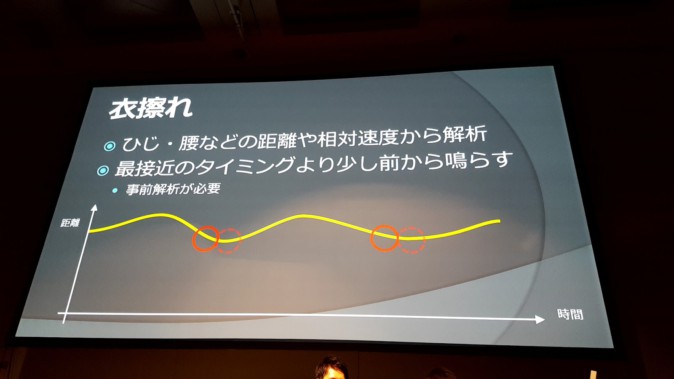

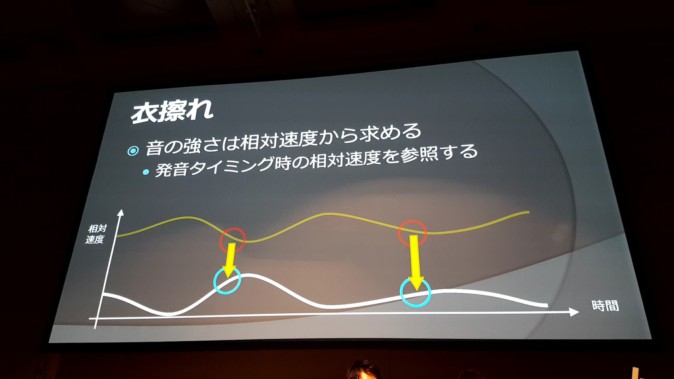

ただし、「足音」と「衣擦れ」は音の性質が違うため、それぞれ異なる解析アルゴリズムが適用されているとのこと。

「足音」のアニメーション解析。赤丸の部分が運動エネルギーが最も小さくなった瞬間=地面に足が当たって音が鳴る瞬間。

衣擦れはひじ・腰などの距離・相対速度から解析しているとのこと。

こうした解析ツールを用いることで、キャラクターのアニメーションが変更されても、ツールを一度適用するだけでサウンドを生成することができ、作業量を減らすことができたそう。

ボイス収録とリップシンク

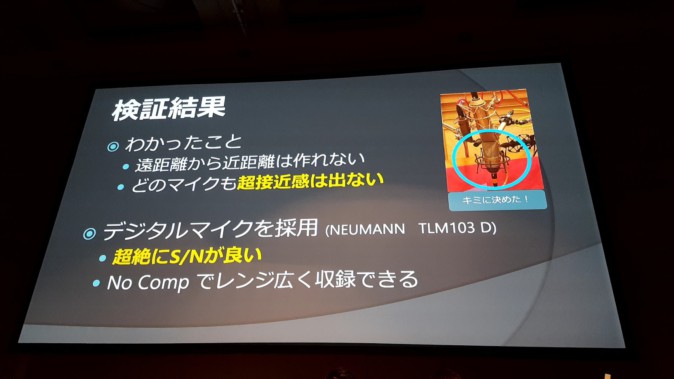

『サマーレッスン』ではゲーム中、ボイスにHRTFを適用する点・距離感がダイナミックに変わる点・BGM無しの状況でしゃべる場面が想定される点などを考え、音声素材収録でも様々な検証が行われました。

またキャラクターがセリフを発する際に唇の動きを同期させるリップシンクも、近くで体験するからこそきちんと処理されていないと粗が目立つそう。

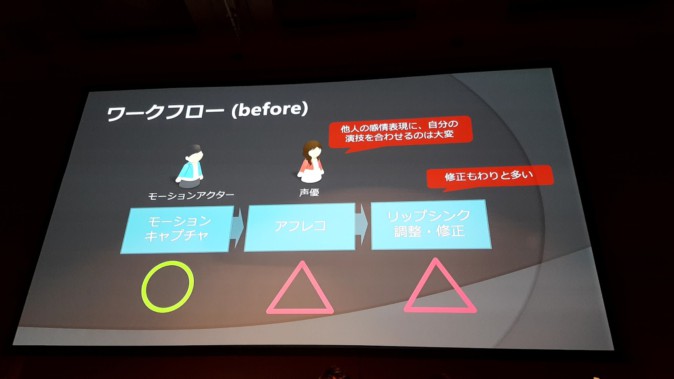

『サマーレッスン』のキャラクターがアニメーション付きでしゃべるまでには、

(1)「モーションアクターによる動きの収録」

(2)「声優によるセリフの収録」

(3)「リップシンク調整」

の3ステップが必要になります。実験の結果、良質な素材が取れないなどの点からモーションキャプチャをしながら音声を同時収録することは避けざるを得ない(声の別録りは必須)と言います。

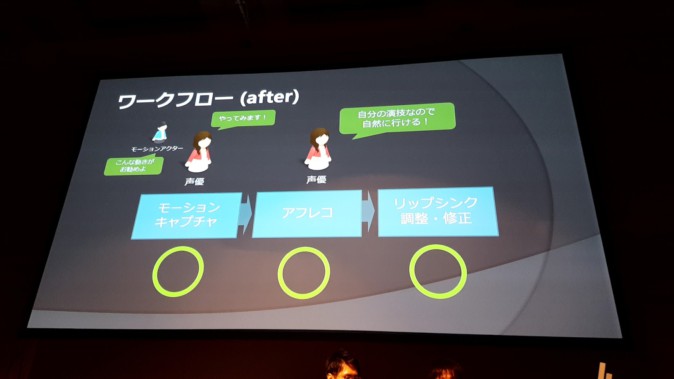

開発負担を減らすために『サマーレッスン』では、「モーションアクターと声優を同一人物にやってもらう」という工夫をしたとのこと。こうすることで声優はアフレコ時に、自分の動きに自分で声をあてるという状況になり、声の演技が動きと合いやすくなって修正回数を減らすことが出来たのだとか。

記事後編では、立体音響技術に関連する「Ambisonics」「HRTF」「バイノーラル」について、個別に詳しく取り扱っているセッションをまとめていきます。

(後編 各論)

3.基礎から応用 3DサウンドAmbisonicでなにができる?(講演ページ)

4.HRTFを極めた者が3Dオーディオを制する!? ~カプコンとヤマハの3Dオーディオプラグイン共同開発事例~(講演ページ)

5.VRサウンドの究極演出 リアルタイムバイノーラルの挑戦(講演ページ)