5月7日から5月9日の期間中、ゲーム制作エンジン「Unity」の国内最大カンファレンスイベント「Unite Tokyo 2018」では、VRやバーチャルYouTuber関連の講演も複数開催されました。

[ads]

5月9日の講演には、ライブプラットフォーム「SHOWROOM」で人気のバーチャル美少女「東雲めぐ」を支える技術を開発している株式会社エクシヴィ(XVI inc.)の近藤義仁(GOROman)氏らが登壇。東雲めぐの「人間らしさ」はどうやって実現しているのか?という内容が披露された講演をレポートします。

「東雲めぐ」とは?

まずは「東雲めぐ」の概要紹介です。東雲めぐは、株式会社シーエスレポーターズ(Gugenka)が生み出したバーチャル美少女。2018年5月現在、SHOWROOMで配信を行っており、毎週月曜日から金曜日の7:30、そして日曜日の19:00からライブ配信を行っています。

下記記事にて、東雲めぐの詳細などを紹介しています。

https://www.moguravr.com/shinonome-megu/

バーチャルYouTuberの配信には、「PERCEPTION NEURON」等のモーションキャプチャーデバイスを使うことが主ですが、東雲めぐにはエクシヴィが開発した配信システム「AniCast」が使用されています。

AniCastは「低コストで、一人でも配信できる」という利便性を考慮したコンセプトとなっており、VRヘッドセット「Oculus Rift」、ハンドコントローラー「Oculus Touch」、パソコン、そしてマイクなど音響機器を組み合わせるシステムとなっています。

東雲めぐに「魂」を入れる

講演には、まずエクシヴィのビジュアルディレクター・室橋雅人氏が登壇。東雲めぐはUnityとFinalIKによる動作を基本としています。室橋氏によると、より人間らしい動きを実現するためには、それに加えて「魂を入れる」ことが重要とのこと。では、魂を入れるポイントとしては具体的に何があるのか? 室橋氏は下記の要素を挙げました。

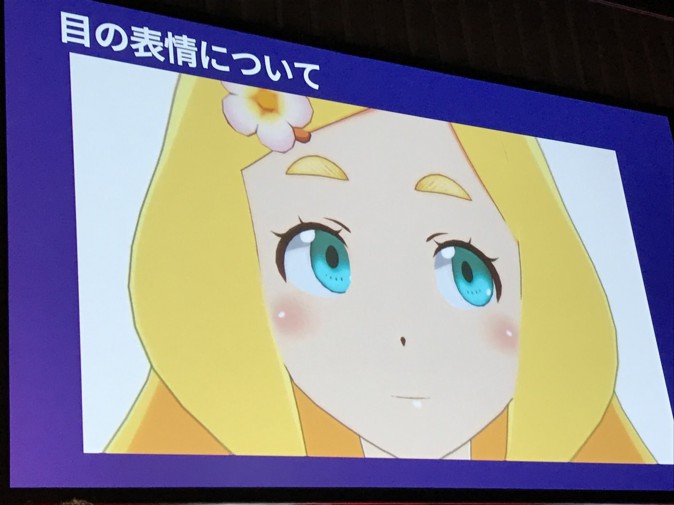

1.目の表情

まずは、「目の表情」について。

人間は、視線を動かすときに眼だけ動くわけではなく、眼の動きにあわせて、まぶたなどの筋肉が動きます。それはアニメキャラクターも同じであり、眼の動きだけだと人間性らしさが損なわれてしまいます。そこで、まぶたの動きを入れると人間らしさが高まる、と室橋氏は説明します。

2.リップシンク

次にリップシンクです。東雲めぐのリップシンクは、「リミテッドリップシンク」を採用しています。アニメ風の口パク表現を実現するため、通常のリップシンクではなく3コマ程度で作るリップシンクです。さらに、よりアニメらしさを持たせるために、配信を行う際には、東雲めぐの動きをアニメと同等の12FPSに落としているとのこと。

3.感情

次に「感情」の話です。様々な感情がマッピングされた「感情の輪」のスライドを引き合いに出しつつ、感情表現だけの場合は見せられるパターンは限られてしまいますが、そこに先述した目の表情をいれることで、より複雑な感情表現として見せている、といったことを説明します。

東雲めぐの「プレゼンス」

次はエクシヴィのUnityエキスパートエンジニア・狩野成太氏が登壇。東雲めぐの「プレゼンス」の話に移ります。プレゼンスとは、日本語にすると「実在感、まるでそこにいるような感じ」のことです。キャラなど制作物のプレゼンスを高めると、本当にそこにいるかのように錯覚する、としています。

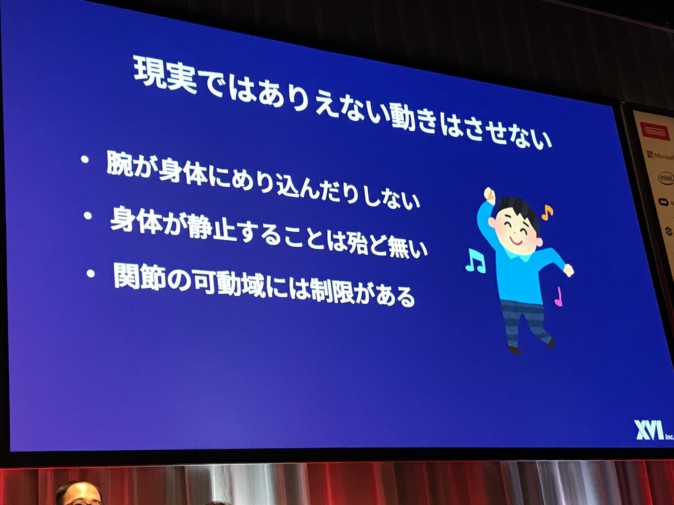

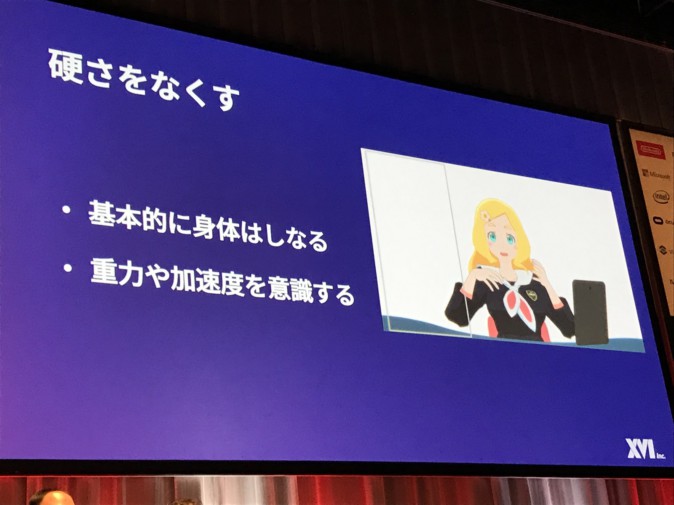

氏はプレゼンスを高める方法として、主に下記の事柄を紹介しました。例としては「現実ではありえない動きはさせない」という部分です。腕が体にめり込まない、身体が停止することは殆どない関節の可動域には制限がある、などの要素を考慮し、現実の物理法則に即した動きをさせることで、実在感を高める工夫が行われています。

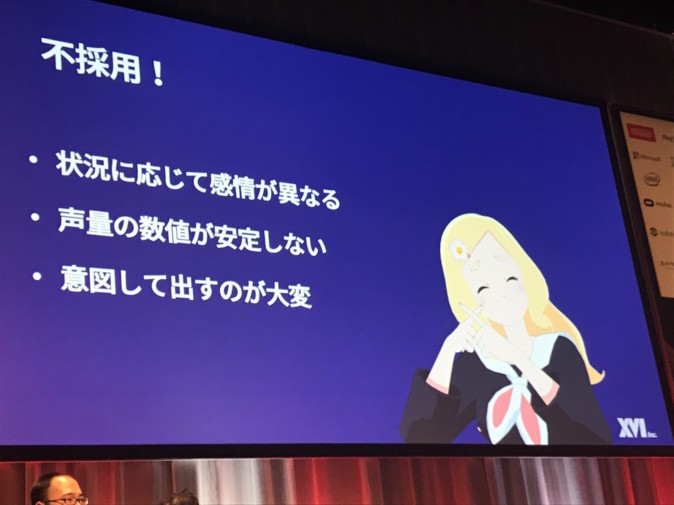

狩野氏はこういった工夫のほかにも、試したけど上手くいかなかったという「没ネタ」の知見を披露しました。まずは「声量と感情を連動させる」という試み。こちらは声量だけで感情を判断することができないため、実装を見送ったとのこと。

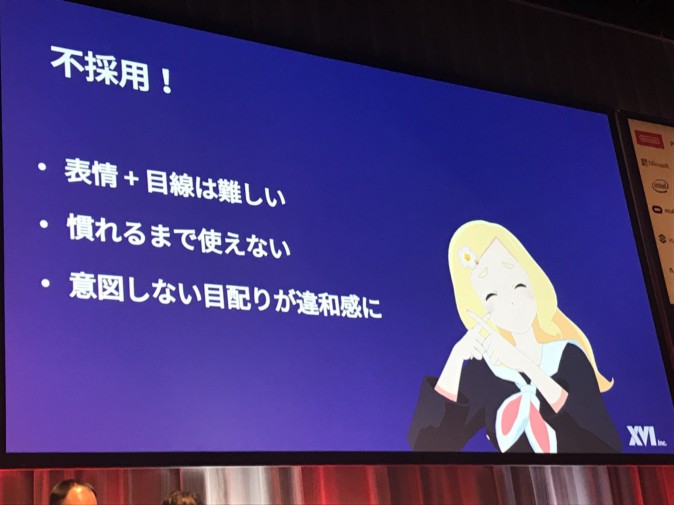

次は「目線をコントローラで操作する」という試み。これは流し目など、表情を意識しながらの目線操作をするということですが、表情と目線を操作する際のラグの問題や、難易度が高いなどの理由で見送られました。

東雲めぐと「音」

次に、エクシヴィのリードオーディオプログラマー吉高弘俊氏が登壇。音声や収録機材について紹介しました。

東雲めぐの収録環境として、配信中に首などを回すので、手にもって握るタイプのダイナミックマイクでは不適。そこで首に巻くタイプのヘッドセットマイクが採用されています。具体的にはSHUREの「WH-20」を使っており、Oculus Touchの操作音も入り込まないとのこと。ミキサーは、東雲めぐ一人でも簡単に設定できるYAMAHAの「AG03」を使用しています。

また、リップシンクはタイミングが命、音声を遅らせて、絵の動きと合わせると「魂が入る瞬間」があるとし、この表現を突き詰めたアニメ風リップシンクを実現するためのライブラリ「AniLipSync」はMIT Licenseとしてgithubに公開されています。

今日の講演で公開した「AniLipSync」のリポジトリです! アニメ風リップシンクをOVRLipSyncで実現するためのライブラリです。 https://t.co/C6HMG7BNwp

— H.Yoshitaka (@TyounanMOTI) 2018年5月9日

配信のモニタリングについて

配信時の動作ログ収集についても紹介されました。東雲めぐは自宅で配信しており、その場ですぐ様子を見れないため、フレームレートやCPU使用率、メモリ使用率やコメント・ギフトの量を集積しています。重大なエラーの発生時はSlackに投稿され「みんな飛び起きる」ようになっているとのこと。

最後には東雲めぐの生出演も!

講演の最後には今後の予定を紹介、そしてサプライズで、東雲めぐ本人が生放送で出演。東雲めぐとの会話も行うことができました。

出席者からの「これからやりたいことは?」という質問に対し東雲めぐは、「初音ミクちゃんが好きなので、彼女みたいにマジカルミライのような舞台に立ちたい」と抱負などを語りました。講演には東雲めぐを知っている方が多かったため、大きく盛り上がった中で講演は終了しました。