XR/メタバースをテーマとした国内最大級のカンファレンス「XR Kaigi」が今年度も開催されました。今年の「XR Kaigi 2023」は「さらに未来に近づく10年へ」をテーマとし、オンラインと現地、双方で計60以上のセッションが実施されています。

今回はその中から、12月21日に行われたセッション「ロケーションベースXRの可能性〜『攻めるVPS』の活用例と展望〜」をレポート。登壇者は、SoVeC株式会社 代表取締役社長の上川 衛氏、株式会社バスキュールの桟 義雄氏、株式会社D2C ID の前野 剛宏氏です。

SoVeCの語る「ロケーションベースXR」のポテンシャル

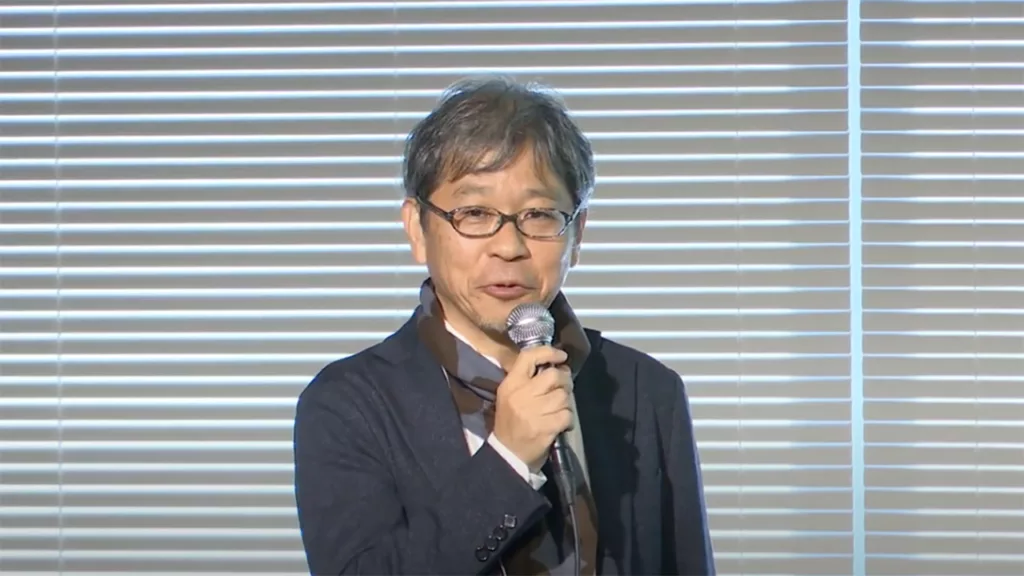

最初に登壇したのはSoVeC株式会社 代表取締役社長の上川 衛氏。ソニーグループの一員であるSoVeCは、「テクノロジーの力で、コミュニケーションを進化させる」をミッションに、バーチャル空間プラットフォーム「そのままシリーズ」や、ARメディアアプリ「XR CHANNEL」等を開発しています。

SoVeCのアプリ「XR CHANNEL」は、スマートフォンのカメラ画像と、事前に作成された3Dマップを照合することで、VPS(Visual Positioning System)を活用。センチメートル単位の精密な位置認識を実現しています。上川氏はこの高性能VPSを「ビタビタVPS」と表現しており、セッション中に披露された動画からも精度の高さがうかがえます。

(SoVeCによるARコンテンツの一部。特に中央の「ビルの壁面が剥がれ、中からアーティストが現れてパフォーマンスを行う」コンテンツでは、高精度VPSにより、ARコンテンツがピッタリとビルに貼り付いている)

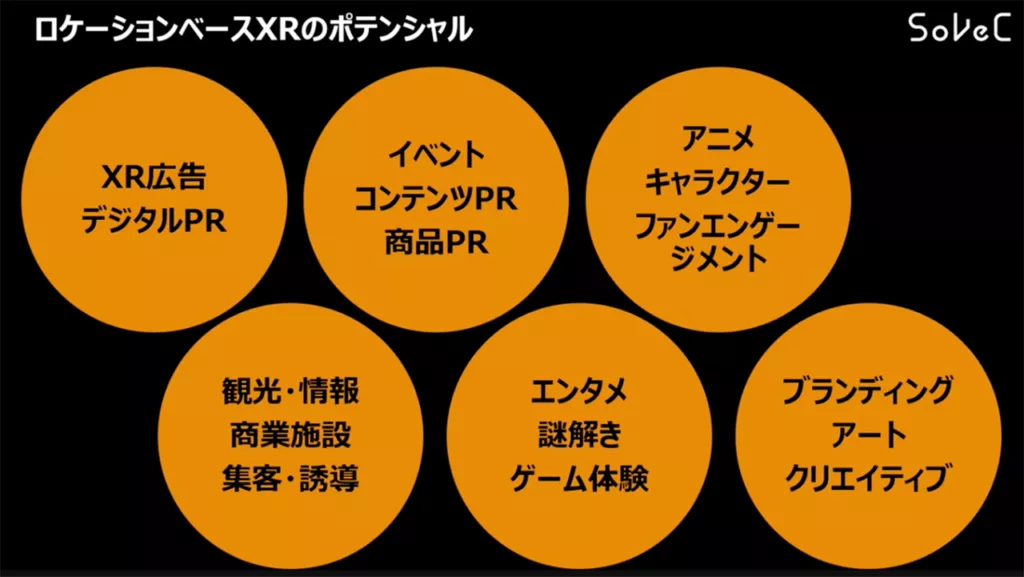

上川氏は「複数のプロジェクトを経て、高精度VPSを活用したロケーションベースXRには高いポテンシャルを感じている。今後はありとあらゆるところで活用が進むのではないか」と述べました。

「ビタビタVPS」の実力、厳しい条件下でもピッタリ貼り付くAR

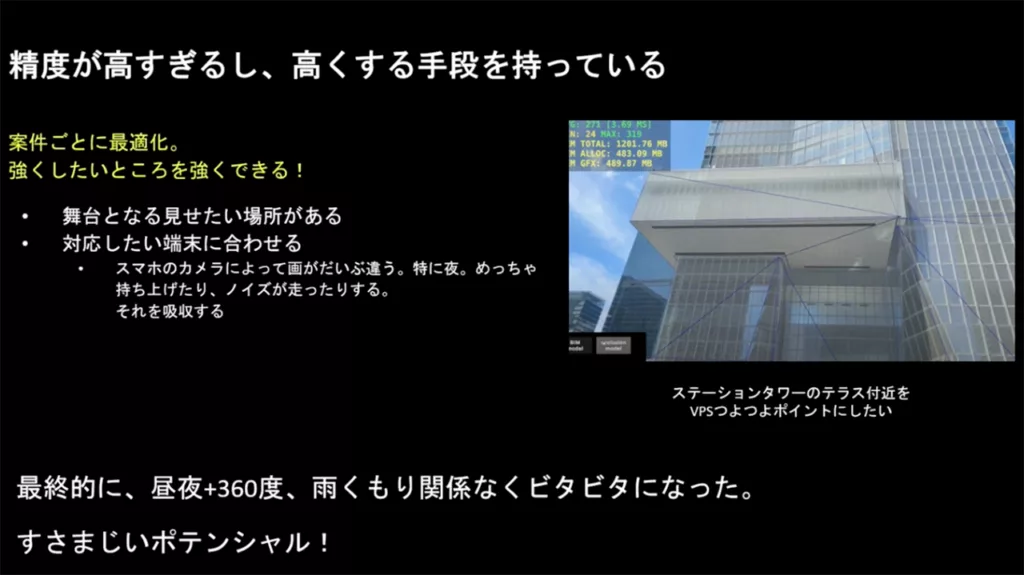

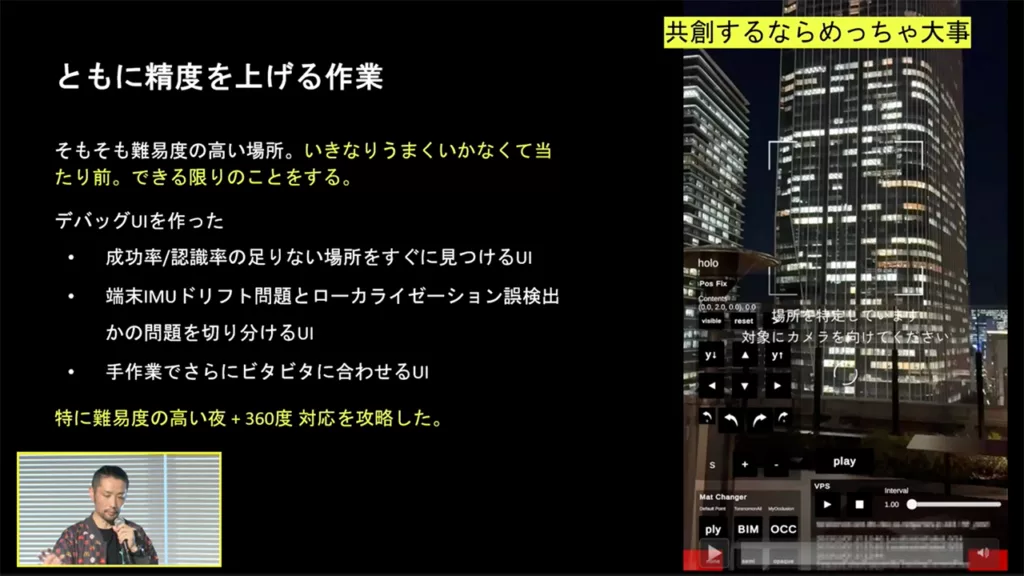

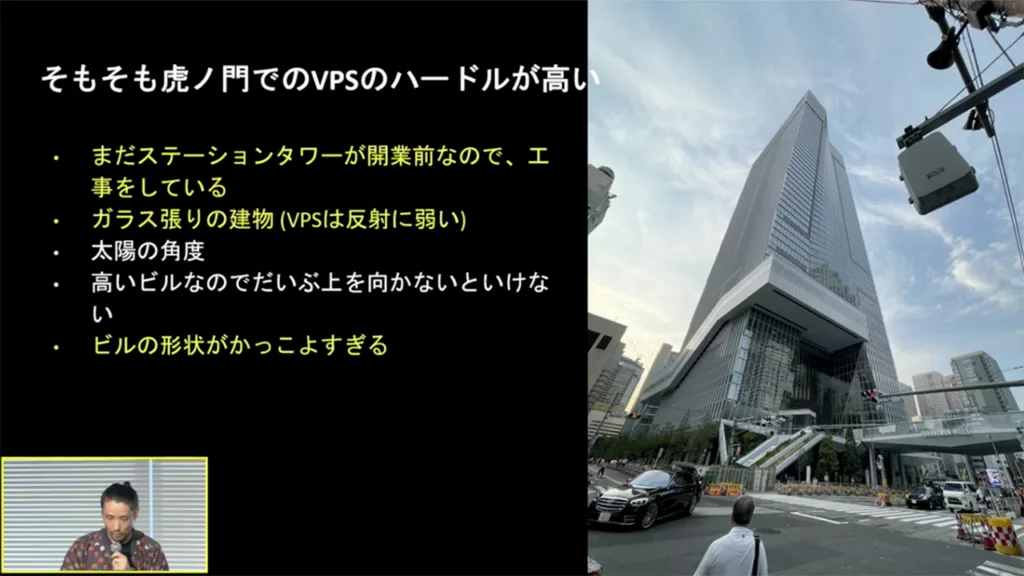

続いて登壇したのは、株式会社バスキュールの桟 義雄氏。虎ノ門ヒルズの複合施設「TOKYO NODE」を舞台としたARアプリ「TOKYO NODE Xplorer」を開発しています。桟氏いわく、このアプリでは、「ソニーの高精度VPSとSoVeCの技術を活かし、最大限街を活かす演出をした」とのこと。

(虎ノ門ヒルズのビル4棟を3Dスキャンし、VPSを活用。ビルにしっかりとARコンテンツが貼り付いている)

桟氏はVPSの基礎を紹介したうえで、「TOKYO NODE Xplorer」のARコンテンツの制作プロセスを語りました。虎ノ門周辺では高精度なVPSの実現が困難な傾向にあるものの、今回はさまざまな試行錯誤を経て、非常に高い精度での「ビタビタVPS」が実現しました。

(工事が現在進行系で行われているため、たびたび3Dマップの更新が必要になる。また虎ノ門ヒルズステーションタワー自体がガラス張りになっているため、本来はVPSに厳しい環境だ)

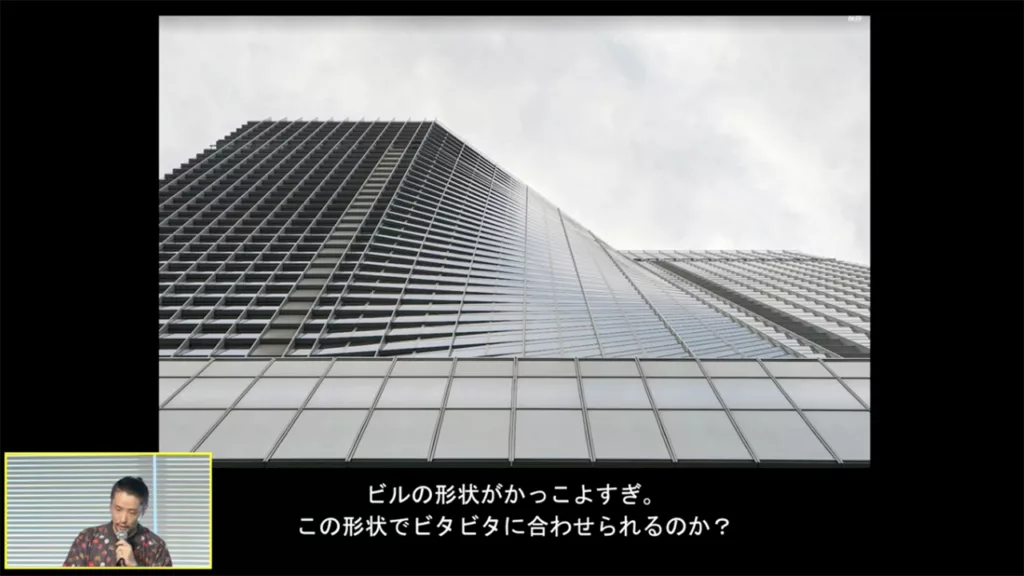

(虎ノ門ステーションタワーの壁面。一部が曲面になっており、当初はVPSがビタッと合うかどうか、オクルージョンが上手くいくかどうかに懸念があったとのこと)

SoVeCがVPS用にスキャンした点群の精度について、「近景はもちろん、遠景の精度も非常に高い。建築用のBIMデータと比較しても驚くほど」と語る桟氏。ユーザーの立つ場所に合わせた最適化や、対応端末ごとのカメラの違いも吸収し、「昼夜問わず」「360度全方向から」「天候関係なく」貼り付くVPSを作り出すことに成功しています。

これについて、SoVeCの上川氏は「従来のVPSであれば夜は動作しないが、精度の高さに加え、夜もビルの明かり等を使うことで検出を可能にしている。昼夜それぞれの3Dマップをブレンドしたほか、昼夜で異なる特徴点を取り扱えるようにした」とコメント。SoVeCのVPS精度の高さや、さらなる性能向上のための取り組みが垣間見える内容となりました。

高精度VPSだからこそ可能なクオリティアップ

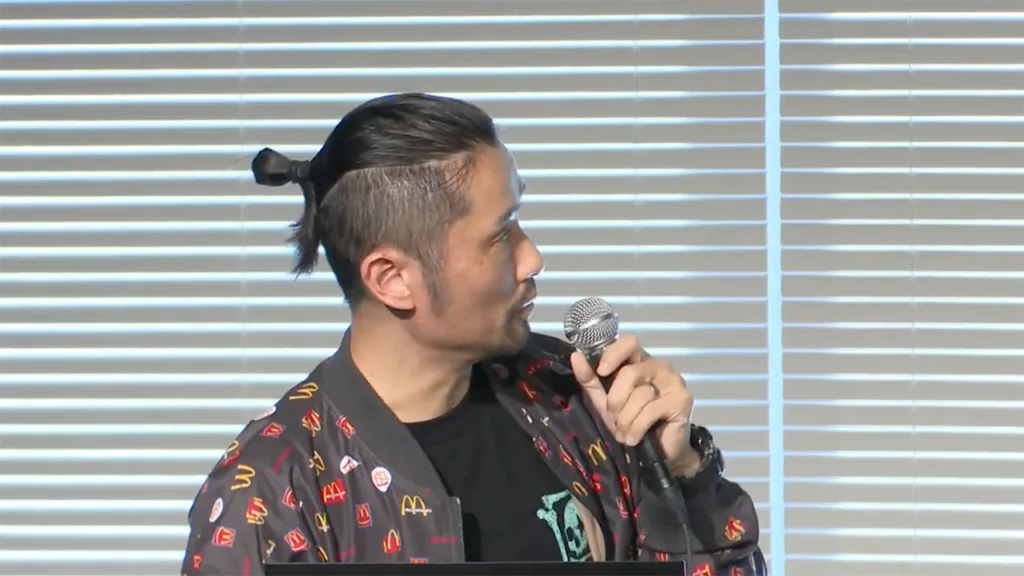

ここで登壇者は株式会社D2C IDの前野 剛宏氏に交代。精度の高いVPSが使える前提のもと、3DCGで「現実のような存在感」を演出するためのテクニックについて語りました。

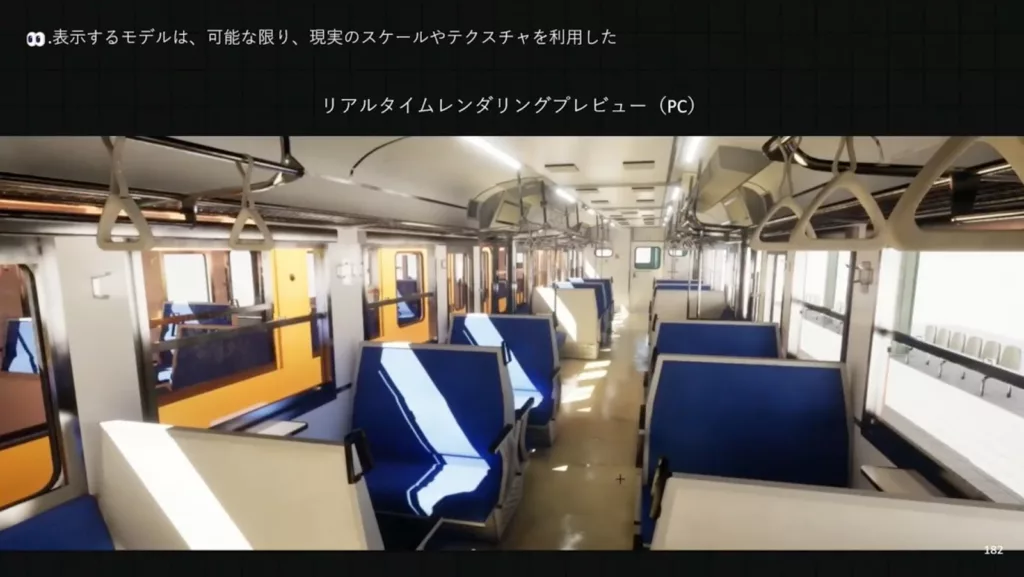

前野氏は、2023年に「XR CHANNEL」を使用した「超駅博 上野」の事例を紹介。下掲の動画のように、高クオリティな電車の3DCGが精度高く表示されています。

(JR東日本と実施した「超駅博 上野」のARコンテンツ。外装の質感やキズ、内装を細部にわたって忠実に再現している。駅のホームにピッタリ貼り付くように表示されており、VPSの精度の高さがよく分かる)

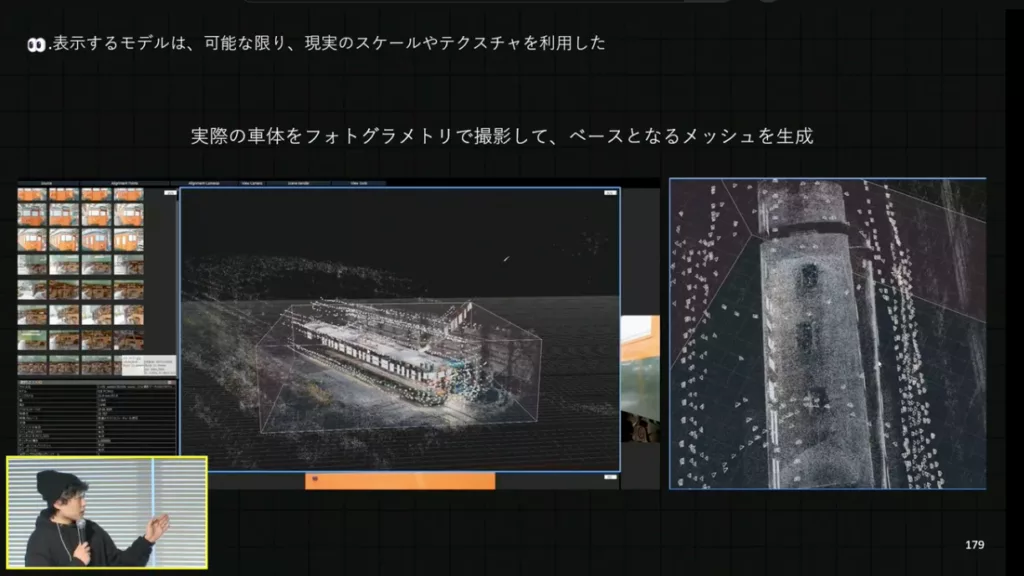

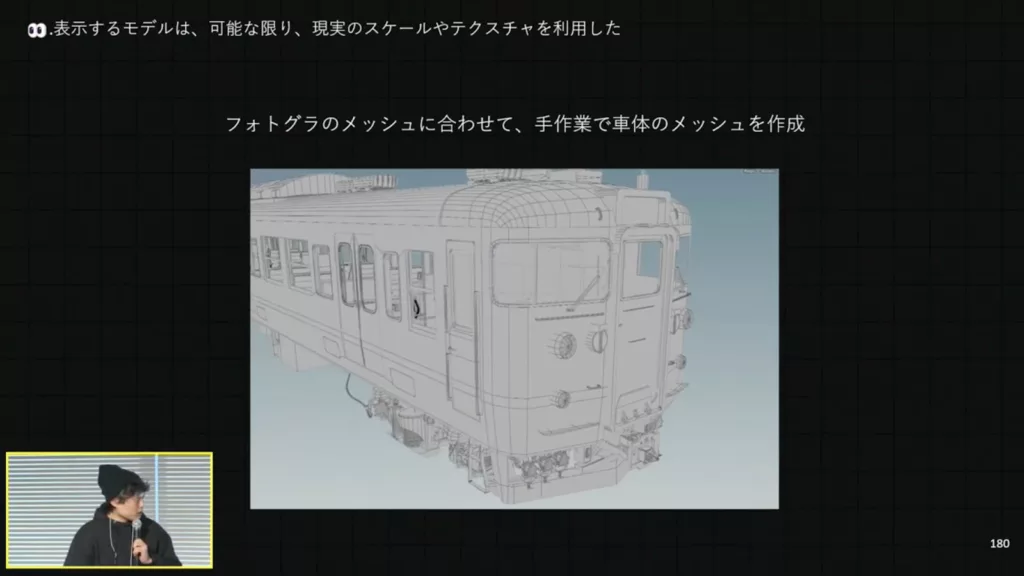

前野氏が心がけたのは「表示する3DCGモデルは、可能な限り現実のものに準拠する」こと。「超駅博 上野」で使われた電車のモデルは、実際の車体をフォトグラメトリで撮影しています。このデータから生成したメッシュを参考に、手作業で新たなメッシュを作ることで、ポリゴン数を抑えつつ説得力のあるスケール感を実現しました。

(電車等をフォトグラメトリで撮影する場合、表面が光を反射してしまうため、そのままではメッシュがうまく形成されず、形が歪んでしまう。そのまま利用することは難しい)

(点群データをもとに手作業で作成したメッシュ。「単純なモデルではあるものの、実際の点群データからメッシュを作成したことで、説得力のあるスケール感に仕上がった」と前野氏)

テクスチャには実際の車体にある特徴的なキズやサビを描き込んで、よりリアルな表現に。その後「Unreal Engine」にデータをインポートし、リアルタイムレンダリングのプレビューを行いました。SoVeCの上川氏によれば、このプレビューは「非常に好評だった」とのこと。

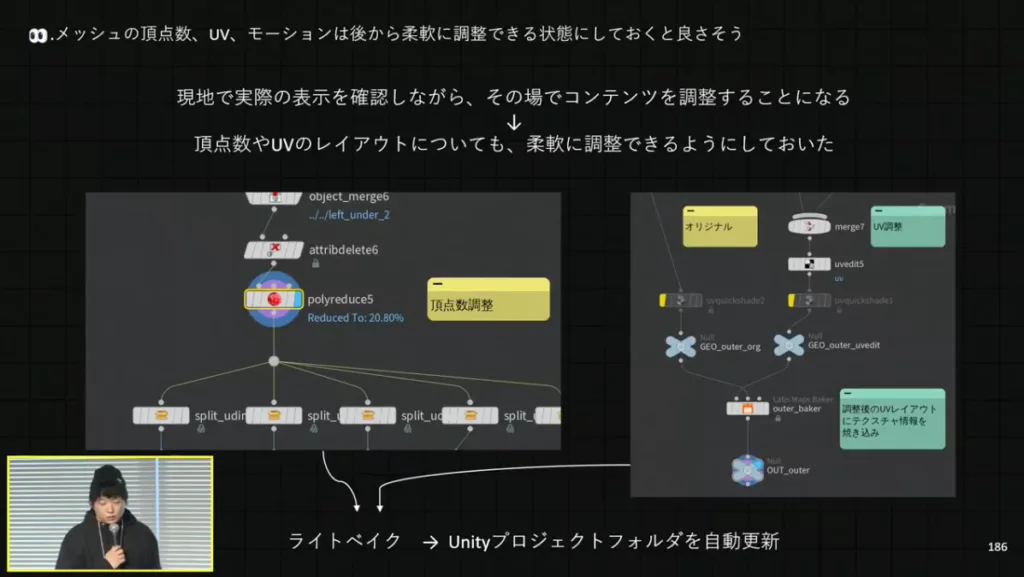

3DCGモデルをリアルに見せるための工夫はまだまだ続きます。前野氏は上野駅の点群データから生成したメッシュを使用、現実空間の光の当たり方や遮蔽物をHoudini上で再現したのち、ベイク(光の当たり方などを、事前にテクスチャに書き込むこと)を行っています。「レガシーなやり方ではあるが、現実の風景に3DCGを重ねる際には非常に重要」と前野氏。

さらに、現地でのコンテンツの調整・変更を可能にするための下準備も。Houdini上でのノードの構成を工夫することで、メッシュの頂点数やUVのレイアウト変更を容易に。アニメーションの尺を調整するためのコントローラーを準備するなど、「現地で見て初めて分かること」にすぐ対応し、コンテンツ品質を上げるための工夫が凝らされていることがわかります。

“ビタビタVPS”を「たくさんのデベロッパーに提供していきたい」

ここで登壇者による発表は一旦終了し、質疑応答に移りました。会場からの「3Dマップを作成するために、多数の機種で撮影を行ったのか?」という質問に対し、上川氏は「さすがにあらゆる機種で撮影してはいないが、代表的な機種のデータを反映させている」「3Dマップは一眼カメラで撮影したデータをもとに構成しているが、昨今のスマホが夜景も非常に明るく撮れることを考慮しつつ、昼夜双方で確認できるように設定している」と回答しました。

また、「リアルタイムでの自動的なオクルージョンに対応するような展望は?」という質問には、上川氏は「5m以内に人物が入ってくるようなケースであれば、多くのアプリで行われているように、LiDAR等を使って検知するような仕組みを試している」とコメント。前野氏は、「リアルタイムでのオクルージョン反映は、モバイルでは通信環境によってズレが生じる可能性が高い。自分たちは多少ズレたとしてもそれが目立たないコンテンツの見せ方を行っている」と答えました。

最後にSoVeCの上川氏は、「セッションで紹介されたようなコラボレーションは、非常に楽しく、新しいものを生むことは非常にエキサイティングだと思う」「特にVPSに関しては、たくさんのデベロッパーの方々に提供できるようにしていきたい。興味がある方はぜひお声がけください」と呼びかけ、セッションを締めくくりました。

【Sponsored】SoVeC