シンガポール国立大学などの研究グループが、従来より高精細な3D画像を2Dカメラ1台で作成できるレンダリング技術「HOSNeRF」を発表しました。

(出所:Jiawei Liu)

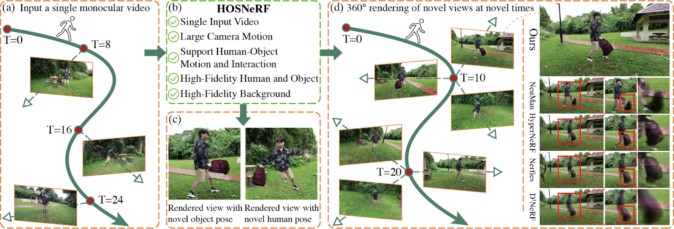

シンガポール国立大学などからなる研究グループは、1本の動画から任意の時点での360°画像を作成できる新たなレンダリング技術「Human-Object-Scene Neural Radiance Fields(HOSNeRF)」を発表しました。360度カメラで撮影していない動画でも、従来手法より高精細に人物の動きを表現できます。

(出所:「HOSNeRF」プロジェクトページ)

「HOSNeRF」とは

今回発表された「HOSNeRF」のベースとなっているのは、「Neural Radiance Fields(NeRF、ナーフ)」と呼ばれる技術です。

「NeRF」は、複数アングルから撮影された2D画像から、深層学習を活用して3D画像を作成する手法です。2020年に「NeRF」が登場して以来、2D動画から3D画像を生成するための技術開発が進められてきました。そのひとつが「HOSNeRF」です。

「HOSNeRF」を使えば、1本の動画から任意の時点での360°画像を作成できます。研究メンバーの1人が投稿した動画で、撮影した映像をさまざまなタイミングで停止させて360°画像を作成している様子が確認できます。

(出所:Jiawei Liu)

動画の自由視点レンダリングにおける課題を解決

構図が固定された画像とは異なり、動画では被写体(例:人間とテニスラケット)の間に複雑な相互作用(例:テニスをする)が生まれます。また、人間はずっとラケットを持ち続けるわけではなく、ラケットを置いたり、代わりに鞄を持ったりすることもあります。このような人間-物体間の相互作用や物体の持ち替えを正確に描画するのは難しく、動画の自由視点レンダリングを行う際の課題だとされてきました。

これらを解決するため、「HOSNeRF」は人間の骨格と物体の骨格をつなげて表現する仕組みや、物体の状態変化を扱う仕組みを導入。物体と環境の相互作用を伴う動画において、高精度な自由視点レンダリングに成功しました。

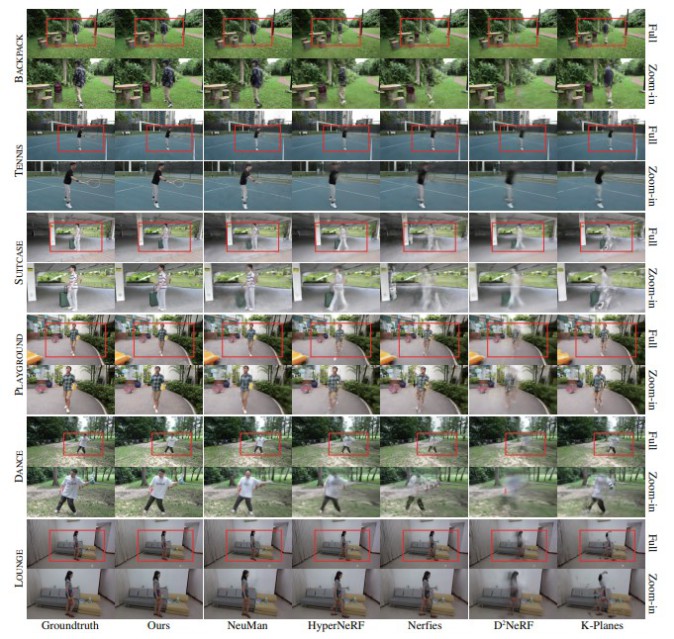

研究チームが作成した比較画像を見ると、他の手法と比べて被写体のアレ・ブレ・ボケが少ないと分かります。

(出所:論文 Fig.4。提案手法は「Ours」と表記)

動的な背景表現が今度の課題

研究グループは論文内で、「HOSNeRF」はあくまでも「人間と物体」の動的なモデリングに焦点を当てた手法であり、「背景」を動的に表現する機能は不足していると述べています。

さらに研究が進めば、背景の忠実なレンダリング手法が開発される可能性もあるでしょう。

(参考)「HOSNeRF」プロジェクトページ、論文