2018年11月14日から16日の3日間にかけて、千葉・幕張メッセにて「デジタルコンテンツEXPO 2018(DCEXPO 2018)」が開催されました。本記事では「DCEXPO 2018」に出展されていたVR・AR関連の展示の中から、興味深いものをいくつかピックアップしてお伝えします。

DCEXPOは、3DCGや映像技術、VR分野だけでなく、触覚や嗅覚に訴える表現や認知科学の成果など、複数ジャンルのコンテンツ技術が並ぶ国際イベントです。会場での展示や体験に加え、研究者やクリエイターによる講演やシンポジウムも多数開催されており、先端技術に関心のある人にとって見どころの多いイベントとなっています。

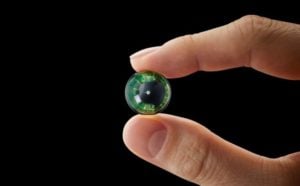

AffectiveHMD:組み込み型光センサを用いた頭部装着型ディスプレイ内での表情認識技術

慶應義塾大学理工学部杉本研究室の開発した「AffectiveHMD」は、VRヘッドマウントディスプレイ(VRHMD)の内部でユーザーの表情を認識する技術です。HMDの内側に多数の反射型光センサーを組み込み、センサーと顔の皮膚表面との距離を取得します。基本的な表情でのセンサー値の分布を機械学習することで、ユーザーがどういった表情を浮かべているかを判別する仕組みです。

センサーはあくまで、HMDの内側の顔には直接触れない位置に組み込まれているため、HMDの使用感は通常時とまったく変わりません。普段はこうしたHMDを装着していると表情が見えないというイメージがあるため、その内側のリラックスした状態での表情が認識されると、こちらとしては不意を突かれた感じでちょっと驚かされました。

今回の展示のように、HMD装着時のユーザーの表情をアバターに反映できるようになれば、ソーシャルVR(「VRChat」など)でのコミュニケーションではたいへん有用でしょう。また、ユーザーの表情から感情を推測することでコンテンツの内容を変化させる、などの応用も期待できます。今後実用化されれば、かなりの発展性がある技術ではないでしょうか。

Noitom x VTuber

モーションキャプチャーデバイスの開発で知られるNoitom International, Inc.は、「Noitom x VTuber」と題して、バーチャルYoutuber(VTuber)向けのソリューションを出展していました。

会場ではNoitom社の全身モーションキャプチャーデバイス「Perception Neuron」と、「Facerig」を組み合わせた形でのデモンストレーションが行われていました。「Perception Neuron」は、“Neuron”と呼ばれる独立センサーを全身で最大32個まで同時に処理することにより、リアルタイムでのモーションデータ作成が可能になるデバイスです。個々のセンサーにIMU(慣性計測装置)が内蔵されており、外部のカメラなどは不要なため、簡易な設備でも全身の動きをリアルタイムに取得できます。

会場のデモでは全身の動きをキャプチャーしていたため、表情に関しては首回りに取り付けた補助具にカメラを固定して使用していました。表情のみをキャプチャーする用途であれば、通常のWebカメラなども利用可能とのこと。

「Facerig」による表情の認識精度はかなり高く、言葉を発する際の口の形まで正確に再現されていたほか、前髪の下に隠れた眉毛の動きなども認識されていました。リアルタイムのアニメーションなので、ライブストリームにも使用できます(現に多くの配信者がFacerigを利用して配信しています)。「Perception Neuron」と組み合わせることで、より幅広い表現が可能になっていました。

インテリIK -VRのヘッドセットや手の位置から、キャラクターの豊かな動きを生成する技術-

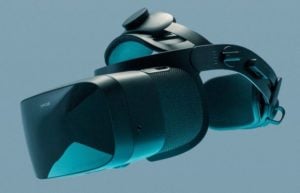

「インテリIK」は、株式会社エクシヴィと株式会社オーパスが開発した、VRのキャラクターの動きをより高い次元で生成できるモーションコントロール技術です。AI・機械学習の活用によって、従来のIK(インバース・キネマティクス)よりも人間の動きに近い姿勢や動作を、仮想空間上で表現できます。

「インテリIK」の使用時には、頭と両手の3点のみを外部センサーで検知します。Oculus Riftのように外部のカメラを使用するVRシステムであれば、基本となるデバイス一式だけで利用可能なため、モーションの精度を手軽に向上させることが可能です。

このように検知するポイントが少ない状態で、従来のIKを使用してアバターの姿勢や動作を推測すると、どうしても関節の動きなどに不自然なところが出てきてしまいます。「インテリIK」では、事前にモーションキャプチャーされた実際のアクターの動きを機械学習することで、より自然な骨格や筋肉の動きをリアルタイムに推測できるようにしているそうです。

取材の時点では残念ながらデモンストレーションが行われていませんでしたが、キャリブレーションから実際にアバターを動かすまでは2~3分で可能とのこと。今後、実際に利用されるようになれば、各種のコンテンツからVRチャットまで幅広い用途に活用できそうです。

FairLift:水面反射を用いた空中像とのインタラクション

電気通信大学情報学専攻小泉研究室により開発された「FairLift」は、水中や水上に裸眼で視認できる映像を表示し、その映像を素手で水ごとすくい上げることができるという映像インタラクションシステムです。

空中に映像を投射する従来のシステムでは、映像の奥に手を伸ばしたりすると奥行きの整合性が崩れてしまい、映像が乱れるという問題が存在していました。この「FairLift」では、水槽の後方に配置された偏光ディスプレイを通して映像を水中や水上に投射することで、映像の奥にある物体が影響しない設計となっています。

さらに、水槽の上方に取り付けられた超音波センサによって水位のトラッキングを行うことで、水面の位置が変化しても映像のズレが発生しないようになっています。これにより、映像の映し出された水を手ですくって持ち上げても、映像が乱れることがないのだそうです。

展示されたシステムは、すくった水を高さ20cmぐらいまで持ち上げても映像が乱れないそうですが、後方の偏光ディスプレイを高くしていけば、さらに高さは伸ばせるとのこと。水に特殊な加工などを行う必要もなく、複数の人が安全に映像を見ることができるため、子どもなど不特定多数の人々が訪れる公共空間での利用を想定しているそうです。映像が水面でわずかに揺れる、ふんわりとした優しい雰世界観も魅力的で、幅広い応用が期待できるでしょう。

グラスレス3D & VR & AIコンテンツ

こちらは文教大学情報学部による出展で、同学部では情報システム学科、メディア表現学科、情報社会学科のすべての学科にコンテンツ系教員を配しており、インタラクティブな総合的VRコンテンツの開発を目指しているとのこと。今回のDCEXPOには、グラスレス3Dをはじめ、津波の避難行動や歴史的景観のシミュレーション、ユーザーの表情に反応するキャラクターなど、多彩なコンテンツが展示されていました。

展示ブースの中でも特に目立っていたのが、大型サイズのディスプレイによるグラスレス3Dの立体視映像です。取材時には、VRではおなじみの360度全天周3Dカメラで記録された実写映像が再生されていました。

映像自体はあらかじめ記録されたものですが、3D立体視の表示はリアルタイムで行っているため,インタラクティブな操作による視界の変更も可能です。立体視のクオリティはまだ調整中とのことで、やや粗さを感じるところもありましたが、実景の3D立体視はやはりインパクトがあり、多くの人が足を止めて眺めていました。

グラスレス3Dディスプレイはもう1種類、「Looking Glass」と呼ばれるホログラムディスプレイのデモも行われていました。

こちらは写真のようにかなりの厚みがあるディスプレイにホログラム映像を表示するもので、この厚みによって、映像に奥行きを持たせることが可能になっています。会場のデモでは、カラフルな空間の中で女性が踊る、3DCGの映像が再生されていました。

こちらもただ映像が再生されるだけでなく、Leap Motionデバイスを使用してディスプレイの上に手をかざすことで、光の玉のようなカーソルを上下左右に加えて前後の奥行きまで移動させることができました。さらには、ディスプレイの上で手を振ると大量のからあげが空中から降ってくるといったギミックも用意されています。

展示ブースではこのほかにも、3DCGやAIを活用したさまざまな研究発表を見ることができました。

「津波避難行動シミュレーションシステム」は、藤沢市や鎌倉市の実際の地形をもとにした3Dマップ上で、タイプの異なる避難者のAIエージェントを移動させて、津波発生時にどのような避難行動が行われるかを可視化したものです。

「歴史的文化街路景観シミュレーション」は、旧東海道藤沢宿の江戸時代の景観を、資料に基づいて3DCGで再現したものです。こちらはゲームパッドによる操作でさまざまな視点から景観を観賞できたほか、季節や時間や天候の違いによる景観の変化も見ることができました。

「ユーザの表情に応じて異なる反応を返すキャラクターデザイン」は、Webカメラで認識したユーザーの表情を分析して4つの感情に分類し、それに対してかわいい女の子のキャラクターがリアクションを返してくれるという内容です。これら3つのコンテンツはいずれもUnityによる開発が行われており、内容もさることながらその開発力も興味深いものでした。

今回ピックアップしてご紹介したコンテンツ技術の多くは、すでに実用化されている、あるいは実用化を前提としているものが多くなっています。これらの技術によって、今後のVR環境や我々の日常生活にどのような変化が起こるのか、大いに楽しみなところです。