2016年に入り、AR(拡張現実)の活用についてグーグルやマイクロソフト、アップル、フェイスブックといった企業の開発者向けカンファレンスで、各々の取り組みが発表されています。これは、ARに注目が集まっていることを意味しています。その中で、グーグルのProject TangoのエンジニアリングディレクターであるJohnny Lee氏に、米メディアRoad To VRの記者がGoogle I/Oの会場でインタビューしました。以下は、インタビューした内容をまとめて記載しています。

デプスセンサーを内蔵するスマートフォンを使用するTangoシステム

グーグルの「Tango」はスマートフォンに通常搭載されているカメラに加えて、魚眼カメラ、デプス(深度)センサーの3つのカメラ・センサーを内蔵するシステムです。グーグル以外のアップルとフェイスブックはデプスセンサーのない通常のスマートフォンをベースにしてARを提供、もしくは提供しようとしています。一方、マイクロソフトは、独自のARヘッドセット「HoloLens」を発売しています。各社によりARで使用するデバイスが異なるのは特徴的です。

Tangoはデプスセンサーがあることにより、カメラ映像にデプス情報を合成し、その結果を用いて現実のオブジェクトが何であるかを認識できます。Tangoは位置トラッキングだけでなく、作成したデプス環境を再度利用可能な形で提供できる「エリアラーニング」や、「バーチャルポジションシステム(VPS)」といった機能(後述)があります。

https://www.youtube.com/watch?v=iHN4c7FYXYs

Lee氏は現実の認識が一番難しい点であり、各カメラ単体では認識するのが難しく、カメラの情報を融合することが重要だと述べています。

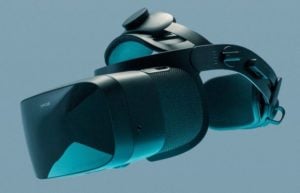

マイクロソフトHoloLensとの違い

マイクロソフトが発売している光学シースルーARヘッドセットHoloLensとTango対応スマートフォンでのARは許容される遅延が異なるとLee氏は述べます。HoloLensは現実の視界も透けて見えているため、少しでも位置トラッキングに遅延があると現実の動きと合わなくなり違和感を感じてしまいます。従って、非常に低遅延なトラッキングが求められます。一方、Tangoはカメラで撮影した映像をディスプレイに表示して見ているため、そこまで低遅延にこだわらなくても問題はありません。

[wc_row][wc_column size=”one-half” position=”first”]

[/wc_column][wc_column size=”one-half” position=”last”]

[/wc_column][/wc_row]

HoloLens(左)とTango搭載スマートフォン(LenovoのPhab2 Pro)

ただ、Tango特有の課題として、3つのカメラを同期して動作する必要があります。また、高フレームレートが求められますが、一般的なスマートフォンで重いアプリケーションを動かしながらカメラを起動すると、時々フレームが落ちてしまう問題が起こります。1つのカメラが落ちてしまうと他のカメラとの同期がとれなくなるため、そうならないようにTangoスマートフォンでは構造から見直しています。これにより、外部センサーを必要としないインサイド・アウト方式の位置トラッキングを実現しています。

特徴的な3つの機能

Tangoには3つの特徴的な機能があります。1つ目は位置トラッキングです。これはデプスセンサーは使わず魚眼カメラをメインに使っています。これまで多くのARでトラッキングシステムには、空間を認識するために人工的なマーカー(目印)を用意する必要がありました。Tangoでは、基準となるマーカーを用意せずに部屋中のオブジェクトを特徴とし位置トラッキングができます。マーカーを使っている場合は、マーカーが見えるようにしかカメラを動かすことしかできないため移動範囲が制限されますが、Tangoならさまざまなサイズの部屋で自由にカメラを動かして使えます。

2つめはデプスセンサーを使うことで物体の奥行きが分かるようになることです。これによってバーチャルなオブジェクトが壁や床に沿って動くことができます。また形状を認識してそれが何であるかを判断できるようになります。たとえば、椅子を見たときは椅子として、テーブルを見たときはテーブルとして認識できます。

3つめはエリアラーニングと呼ばれる環境を保存する機能です。これは、家などで体験するためにスキャンした特徴データを保存しておき、後日同じ環境で体験する際の手間を省くことを目的としています。

似たようなサービスとして、VPS(Visual Positioning Service)がありますが、VPSはGPSが届かないような広い建物内で正確な位置情報を取得できるシステムであり、エリアラーニングが対象としているのは部屋などのより狭い範囲の環境データという違いがあります。グーグルは、このような環境データは容量が大きくなるため、自らがホストとなってユーザーが環境データをアップロード、ダウンロードできるシステムを検討しているとのことです。

このような環境データを再利用しようとする際に気になるのが、どの程度環境が変わったら再度スキャンし直さなければならないかということです。これについてLee氏は、少しでも環境が変わったらスキャンし直しになるのではなく、なるべく簡略化できるようにしていると述べています。

デプス情報の活用

デプスセンサーで取得したデータは、機械学習の分野で話題の意味的領域分割といった手法を用いて部屋の中にあるそれぞれの物体が何なのかを分かるようにしていこうとしています。また、この部分のSDKをアプリ開発者向けに公開し、簡単に使えるようにしていきます。また、Unity向けにPrefabを用意して、衝突判定、トラッキング、接触点検出などのサンプルを用意しています。

位置トラッキング時の誤差

Tangoの位置トラッキング精度は高く、約30m歩いて30cmずれる程度です。これも周辺環境の認識といった機能をより高めていって精度を上げていきたいと考えている、とのこと。

インタラクションのためのUI

スマートフォンVR/ARはユーザーが既に慣れているタッチインターフェースがあります。さらにHoloLensで使われているようなジェスチャーや視線入力など他の感覚も使ったマルチモーダル・インタフェースが重要になってきます。

環境データを保存するときのプライバシーについて

環境の特徴を保存するときに気になるのがプライバシーの問題です。環境に人がいた場合、顔の特徴も捉えて顔認識ができるという懸念があるかもしれません。しかし、人などの動く物体はスキャン時にはノイズとして処理されるため実際にはプライバシーの問題は起こらない、とLee氏は述べています。

将来の展望

環境にある物を具体的に何かを判断する技術も研究が進んでおり、ワシントン大学が機械学習によって撮影した物がどのような家具かを認識できる研究を行っています。

トラッキングの精度は今後も上げていき、より正確な計測ができるようにしたいとのいこと。ARだけでなくロボティクスへの応用などできることが増えていく、とARにとどまらない可能性について言及をしてインタビューは終了となりました。

(参考)

Google’s Tango Engineering Director, Johnny Lee, on AR Capabilities Enabled by Depth Sensors – (英語)

http://www.roadtovr.com/google-tangos-engineering-director-ar-capabilities-enabled-depth-sensors/

MoguraVRはRoad to VRとパートナーシップを結んでいます。